| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

- GPT 멀티챗

- envoy

- Ingress

- aws eks

- argocd

- K8S

- Streamlit 활용한 챗봇만들기

- PuMuPDF

- Kind

- Jenkins

- 멀티에이전트 RAG

- kiali

- Ambient

- Kubernetes

- 랭그래프 목차만들기

- service mesh

- docker

- vpc cni

- 타빌리

- GPT 역할 부여하기

- Istio

- loadbalancer

- WSL

- CNI

- prometheus

- 스트림릿 활용한 GPT

- CICD

- vagrant

- Observability

- grafana

- Today

- Total

WellSpring

AEWS 9주차 - EKS Upgrade [AWS Workshop] 본문

목차

※ 본 게재 글은 gasida님의 'AEWS' 강의내용과 실습예제 및 AWS 공식 workshop 환경을 기반으로 작성하였습니다.

1. K8S 업그레이드

▶ [K8S Docs] Release* : 1년에 3개의 마이너 버전 출시 → 최근 3개 버전 release branches(패치) 지원 - Link

1. Kubernetes 의 릴리즈는 1년에 3개의 마이너 버전을 기본으로 한다.

2. 버전 정보는 Semantic Versioning 방식을 이용한다. - Link

Given a version number MAJOR.MINOR.PATCH, increment the:

- MAJOR version when you make incompatible API changes

- MINOR version when you add functionality in a backward compatible manner

- PATCH version when you make backward compatible bug fixes

Additional labels for pre-release and build metadata are available as extensions to the MAJOR.MINOR.PATCH format.

[ 기본 규칙 ]

- MAJOR version 이 올라가면, MINOR Version 과 Patch Version 은 0 이 되어야 한다.

- MINOR Version 이 올라가면, Patch Version은 0 이 되어야 한다.

- 정식 배포 전에 pre-release 하는 경우 '-' 또는 '.' 을 사용한다.

- 정식 배포 전 git commit 후, 난수가 붙은 형태 그대로 배포하는 것을 Build metadata 라고 부른다.

- MAJOR 에 0 으로 시작하는 경우 (0.y.z)는 초기 개발 버전을 나타내기 위해 사용한다.

3. Patch 관리 - Link

- Upcoming Release 정보를 참고하자!!

- Download - Link

- Release Cycle - Link

- Patch Releases - Link

- Release Managers - Link

- Release Notes - Link

4. Version Skew Policy* - Link

- kube-apiserver : HA apiserver 경우 newest 와 oldest 가 1개 마이너 버전 가능

- newest kube-apiserver is at 1.32

- other kube-apiserver instances are supported at 1.32 and 1.31

- kubelet/kube-proxy : kubelet 는 apiserver 보다 높을수 없음. 추가로 apiserver 보다 3개 older 가능

- kube-apiserver is at 1.32

- kubelet is supported at 1.32, 1.31, 1.30, and 1.29

- 만약 apiserver 가 HA로 1.32, 1.31 있다면 kubelet 는 1.32는 안되고, 1.31, 1.30, 1.29 가능

- kube-controller-manager, kube-scheduler, and cloud-controller-manager : skip

- kubectl : one minor version (older or newer) of kube-apiserver

- kube-apiserver is at 1.32

- kubectl is supported at 1.33, 1.32, and 1.31

2. 가상 온프레미스 환경 K8S에서 업그레이드 계획 짜기

▶ 환경 소개 : k8s 1.28, CPx3대, DPx3대, HW LB 사용 중

[ 구성도 ]

- 구성 요소 및 버전

0. 목표 버전 설정 : K8S 1.32!

1. 버전 호환성 검토

- K8S(kubelet, apiserver..) 1.32 요구 커널 버전 확인 : 예) user namespace 사용 시 커널 6.5 이상 필요 - Docs

- containerd 버전 조사 : 예) user namespace 에 대한 CRI 지원 시 containerd v2.0 및 runc v1.2 이상 필요 - Docs

- K8S 호환 버전 확인 - Docs

- CNI(Cilium) 요구 커널 버전 확인 : 예) BPF-based host routing 기능 필요 시 커널 5.10 이상 필요 - Docs

- CNI 이 지원하는 K8S 버전 확인 - Docs

- CSI : Skip…

- 애플리케이션 요구사항 검토

2. 업그레이드 방법 결정 : in-place vs blue-green

3. 결정된 방법으로 업그레이드 계획 수립

☞ In-place 결정 시,

4. 사전 준비

- (옵션) 각 작업 별 상세 명령 실행 및 스크립트 작성, 작업 중단 실패 시 롤백 명령/스크립트 작성

- 모니터링 설정

- (1) ETCD 백업

- (2) CNI(cilium) 업그레이드

5. CP 노드 순차 업그레이드 : 1.28 → 1.29 → 1.30

- 노드 1대씩 작업 진행 1.28 → 1.29

- (3) Ubuntu OS(kernel) 업그레이드 → 재부팅

- (4) containerd 업그레이드 → containerd 서비스 재시작

- (5) kubeadm 업그레이드 → kubelet/kubectl 업그레이드 설치 → kubelet 재시작

- 노드 1대씩 작업 진행 1.29 → 1.30

- (5) kubeadm 업그레이드 → kubelet/kubectl 업그레이드 설치 → kubelet 재시작

- 작업 완료 후 CP 노드 상태 확인

6. DP 노드 순차 업그레이드 : 1.28 → 1.29 → 1.30

- 노드 1대씩 작업 진행 1.28 → 1.29

- (6) 작업 노드 drain 설정 후 파드 Evicted 확인, 서비스 중단 여부 모니터링 확인

- (7) Ubuntu OS(kernel) 업그레이드 → 재부팅

- (8) containerd 업그레이드 → containerd 서비스 재시작

- (9) kubeadm 업그레이드 → kubelet 업그레이드 설치 → kubelet 재시작

- 노드 1대씩 작업 진행 1.29 → 1.30

- (9) kubeadm 업그레이드 → kubelet 업그레이드 설치 → kubelet 재시작

- 작업 완료 후 DP 노드 상태 확인 ⇒ (10) 작업 노드 uncordon 설정 후 다시 상태 확인

7. K8S 관련 전체적인 동작 1차 점검

- 애플리케이션 파드 동작 확인 등

8. CP 노드 순차 업그레이드 : 1.30 → 1.31 → 1.32

- 노드 1대씩 작업 진행 x 버전별 반복

- kubeadm 업그레이드 → kubelet/kubectl 업그레이드 설치 → kubelet 재시작

- 작업 완료 후 CP 노드 상태 확인

9. DP 노드 순차 업그레이드 : 1.30 → 1.31 → 1.32

- 노드 1대씩 작업 진행 x 버전별 반복

- 작업 노드 drain 설정 후 파드 Evicted 확인, 서비스 중단 여부 모니터링 확인

- kubeadm 업그레이드 → kubelet 업그레이드 설치 → kubelet 재시작

- 작업 완료 후 DP 노드 상태 확인 ⇒ 작업 노드 uncordon 설정 후 다시 상태 확인

10. K8S 관련 전체적인 동작 2차 점검

- 애플리케이션 파드 동작 확인 등

3. Amazon EKS Upgrades: Strategies and Best Practices

☞ Amazon EKS 클러스터 업그레이드 워크숍의 목적은 고객에게 Amazon EKS 클러스터 업그레이드를 계획하고 실행할 수 있는 모범 사례를 제공하는 일련의 실험실을 소개하는 것입니다.

우리는 In-Place, Blue/Green 등 다양한 클러스터 업그레이드 전략을 탐구하고 각 전략의 실행 세부 사항을 자세히 살펴볼 것입니다.

이 워크숍에서는 EKS 테라폼 청사진, ArgoCD 등을 활용하여 전체 EKS 클러스터 업그레이드 프로세스를 안내합니다.

3-1. Getting Start

Step1. IDE 서버 환경 접속 - 오레곤 리전(us-west-2)

- 주어진 URL과 Password 를 통해 Terraform 코드 수정할 수 있는 환경 포함된 IDE 서버에 접속

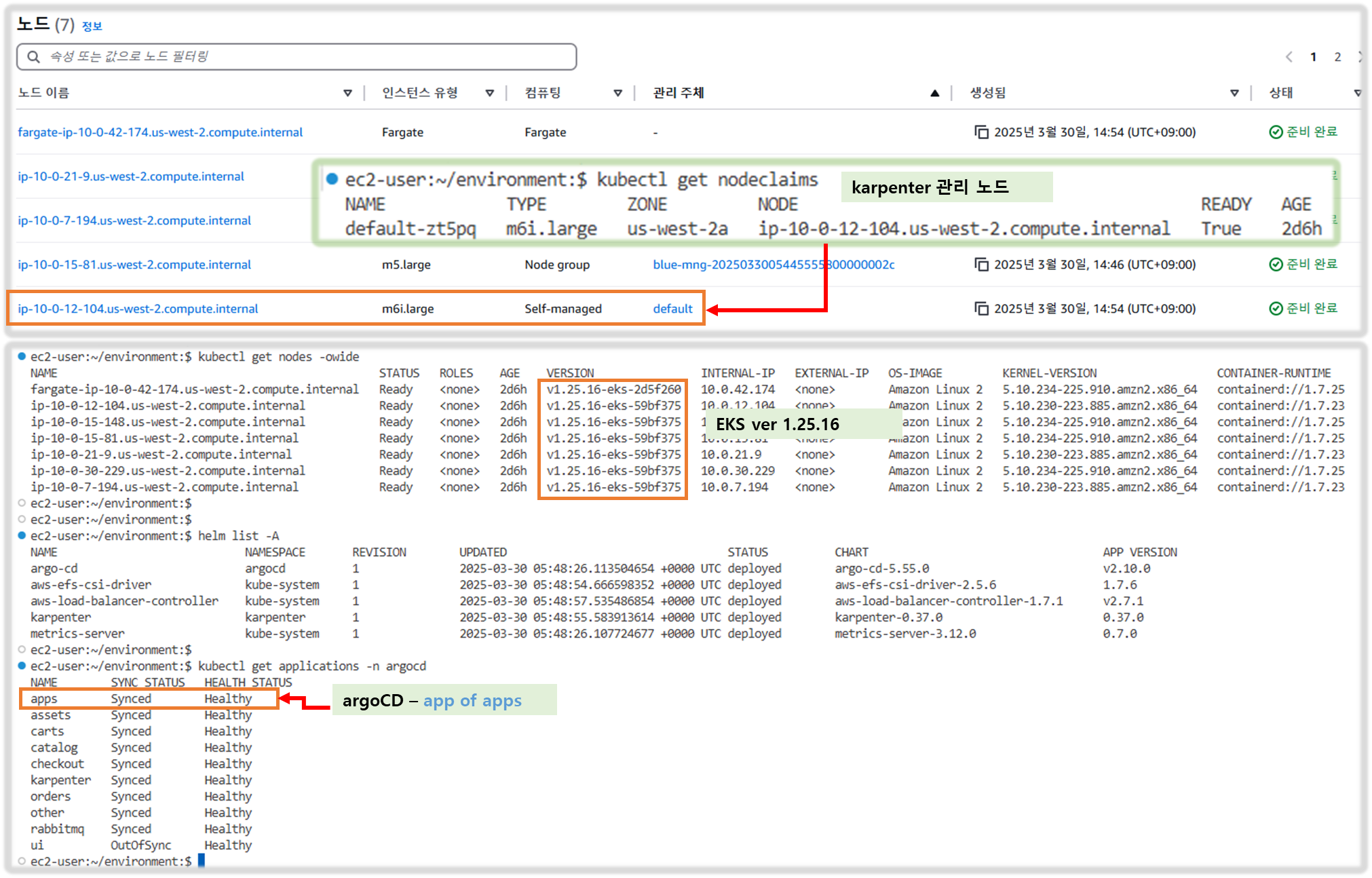

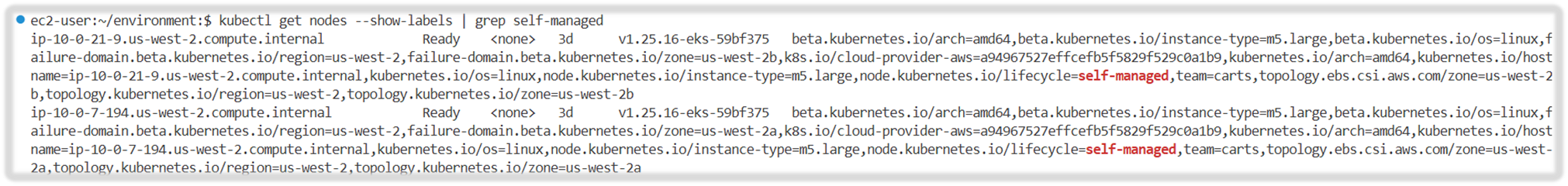

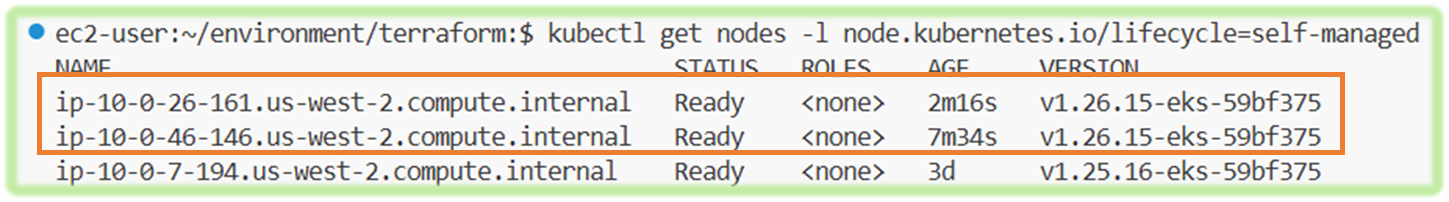

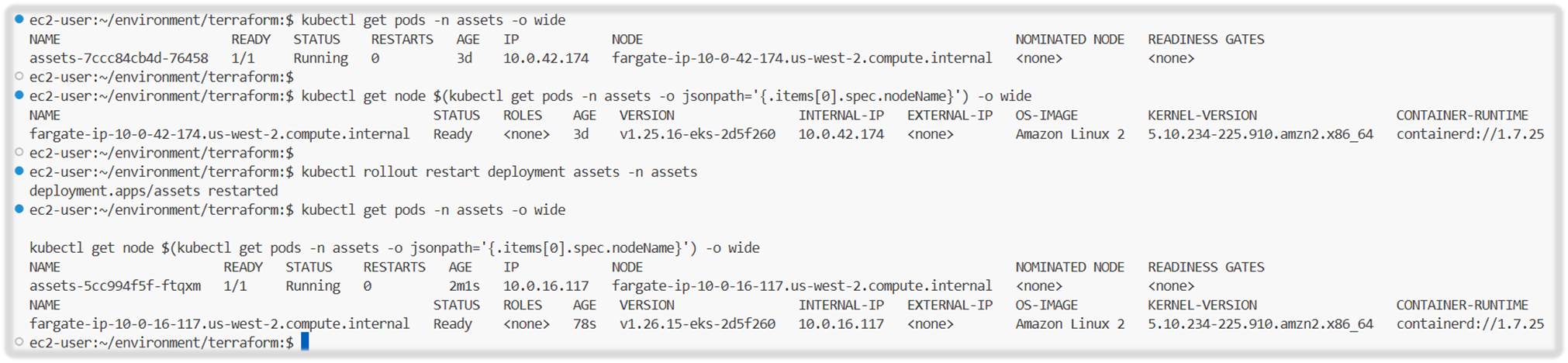

Step2. IDE 정보 확인 : 버전(1.25.16), 노드(AL2, 커널 5.10.234, containerd 1.7.25) - IDE_Link , Self-Mng-Node , KrBlog

1) 기본 정보 확인

#

whoami

ec2-user

pwd

/home/ec2-user/environment

export

declare -x ASSETS_BUCKET="ws-event-069b6df5-757-us-west-2/d2117abb-06fa-4e89-8a6b-8e2b5d6fc697/assets/"

declare -x AWS_DEFAULT_REGION="us-west-2"

declare -x AWS_PAGER=""

declare -x AWS_REGION="us-west-2"

declare -x CLUSTER_NAME="eksworkshop-eksctl"

declare -x EC2_PRIVATE_IP="192.168.0.59"

declare -x EKS_CLUSTER_NAME="eksworkshop-eksctl"

declare -x GIT_ASKPASS="/usr/lib/code-server/lib/vscode/extensions/git/dist/askpass.sh"

declare -x HOME="/home/ec2-user"

declare -x HOSTNAME="ip-192-168-0-59.us-west-2.compute.internal"

declare -x IDE_DOMAIN="dboqritcd2u5f.cloudfront.net"

declare -x IDE_PASSWORD="pKsnXRPkxDvZH2GfZ9IPF3ULW74RbKjH"

declare -x IDE_URL="https://dboqritcd2u5f.cloudfront.net"

declare -x INSTANCE_IAM_ROLE_ARN="arn:aws:iam::271345173787:role/workshop-stack-IdeIdeRoleD654ADD4-Qhv1nLkOGItJ"

declare -x INSTANCE_IAM_ROLE_NAME="workshop-stack-IdeIdeRoleD654ADD4-Qhv1nLkOGItJ"

declare -x REGION="us-west-2"

declare -x TF_STATE_S3_BUCKET="workshop-stack-tfstatebackendbucketf0fc9a9d-isuyoohioh8p"

declare -x TF_VAR_aws_region="us-west-2"

declare -x TF_VAR_eks_cluster_id="eksworkshop-eksctl"

declare -x USER="ec2-user"

declare -x VSCODE_PROXY_URI="https://dboqritcd2u5f.cloudfront.net/proxy/{{port}}/"

...

# s3 버킷 확인

aws s3 ls

2025-03-28 11:56:25 workshop-stack-tfstatebackendbucketf0fc9a9d-2phddn8usnlw

aws s3 ls s3://workshop-stack-tfstatebackendbucketf0fc9a9d-2phddn8usnlw

2025-03-28 12:18:23 940996 terraform.tfstate

# 환경변수(테라폼 포함) 및 단축키 alias 등 확인

cat ~/.bashrc

...

export EKS_CLUSTER_NAME=eksworkshop-eksctl

export CLUSTER_NAME=eksworkshop-eksctl

export AWS_DEFAULT_REGION=us-west-2

export REGION=us-west-2

export AWS_REGION=us-west-2

export TF_VAR_eks_cluster_id=eksworkshop-eksctl

export TF_VAR_aws_region=us-west-2

export ASSETS_BUCKET=ws-event-069b6df5-757-us-west-2/d2117abb-06fa-4e89-8a6b-8e2b5d6fc697/assets/

export TF_STATE_S3_BUCKET=workshop-stack-tfstatebackendbucketf0fc9a9d-isuyoohioh8p

alias k=kubectl

alias kgn="kubectl get nodes -o wide"

alias kgs="kubectl get svc -o wide"

alias kgd="kubectl get deploy -o wide"

alias kgsa="kubectl get svc -A -o wide"

alias kgda="kubectl get deploy -A -o wide"

alias kgp="kubectl get pods -o wide"

alias kgpa="kubectl get pods -A -o wide"

aws eks update-kubeconfig --name eksworkshop-eksctl

export AWS_PAGER=""

# eks 플랫폼 버전 eks.44

aws eks describe-cluster --name $EKS_CLUSTER_NAME | jq

{

"cluster": {

"name": "eksworkshop-eksctl",

"arn": "arn:aws:eks:us-west-2:271345173787:cluster/eksworkshop-eksctl",

"createdAt": "2025-03-25T02:20:34.060000+00:00",

"version": "1.25",

"endpoint": "https://B852364D70EA6D62672481D278A15059.gr7.us-west-2.eks.amazonaws.com",

"roleArn": "arn:aws:iam::271345173787:role/eksworkshop-eksctl-cluster-20250325022010584300000004",

"resourcesVpcConfig": {

"subnetIds": [

"subnet-047ab61ad85c50486",

"subnet-0aeb12f673d69f7c5",

"subnet-01bbd11a892aec6ee"

],

"securityGroupIds": [

"sg-0ef166af090e168d5"

],

"clusterSecurityGroupId": "sg-09f8b41af6cadd619",

"vpcId": "vpc-052bf403eaa32d5de",

"endpointPublicAccess": true,

"endpointPrivateAccess": true,

"publicAccessCidrs": [

"0.0.0.0/0"

]

},

"kubernetesNetworkConfig": {

"serviceIpv4Cidr": "172.20.0.0/16",

"ipFamily": "ipv4",

"elasticLoadBalancing": {

"enabled": false

}

},

"logging": {

"clusterLogging": [

{

"types": [

"api",

"audit",

"authenticator"

],

"enabled": true

},

{

"types": [

"controllerManager",

"scheduler"

],

"enabled": false

}

]

},

"identity": {

"oidc": {

"issuer": "https://oidc.eks.us-west-2.amazonaws.com/id/B852364D70EA6D62672481D278A15059"

}

},

"status": "ACTIVE",

"certificateAuthority": {

"data": "LS0tLS1CRUdJTiBDRVJUSUZJQ0FURS0tLS0tCk1JSURCVENDQWUyZ0F3SUJBZ0lJUG52UE1YVThibmd3RFFZSktvWklodmNOQVFFTEJRQXdGVEVUTUJFR0ExVUUKQXhNS2EzVmlaWEp1WlhSbGN6QWVGdzB5TlRBek1qVXdNakl3TkRSYUZ3MHpOVEF6TWpNd01qSTFORFJhTUJVeApFekFSQmdOVkJBTVRDbXQxWW1WeWJtVjBaWE13Z2dFaU1BMEdDU3FHU0liM0RRRUJBUVVBQTRJQkR3QXdnZ0VLCkFvSUJBUURDMGxZNk9kTkhqQlhyaStPVUd0cHQ1UVl3YUdCZUw5V2s1QkFwSUQrRVllQVQzS1k5VmFQSGhUK2cKdTIyM096SHlXUjNJNjlhbWd2cS94RUg2RUFqRUFUTkxKWHd3MXQ1dVNhaG1Ia3lUWEhtUkl2M3hwQVEzalY0KwpReFQrWWJBYjNpMjdjd3d5OGNRckRBTU1BZUszd29JWmR5OVkxWUx2ZkMxUnA4WEU3bitLcGpRTkE5UmlvYzFxCnU2RGh0bzJ5dHdOTE5WQ0RuRSswbTN2M3AzMlZFTW91UjlMbkFRaEUza1BvL2ZjeVB6VWVQelMwRTdRdTdXSmMKZXJHcGNBbmtFdithRjNiK2p5ZndiWHBFLzFCQWtaZWt2UmtsN0FreVF2ZU5wU1RITEZnZDNMamtnWE52djFEcwp5SUI1UHJKSGV6RTk2UEZFbkRGMGtmZGVaVzNGQWdNQkFBR2pXVEJYTUE0R0ExVWREd0VCL3dRRUF3SUNwREFQCkJnTlZIUk1CQWY4RUJUQURBUUgvTUIwR0ExVWREZ1FXQkJSVm9zWGs2Zyt4ek9ycEd6QTlOU0xnTmVSalhUQVYKQmdOVkhSRUVEakFNZ2dwcmRXSmxjbTVsZEdWek1BMEdDU3FHU0liM0RRRUJDd1VBQTRJQkFRQy9qQWtUMHJRcwpyaDFrZ2ozOG54b3c2WkdsVUxCKzQrY0NPU3p1K3FpNDFTWVpHamliemJXTklBTGIzakFCNEd4Y05sbWxlTVE2Cms5V0JqZk1yb3d6ZHhNQWZOc2R6VStUMGx1dmhSUkVRZjVDL0pNaVdtVWRuZGo1SHhWQmFLM0luc0pUV2hCRlIKSFdEaEcwVm5qeGJiVitlQnZYQUtaWmNuc21iMm5JNENxWGRBdWxKbFFiY201Y25UTDNBOXlYdzY5K1ZucCtmdgo3czFRd3pnWCt0NFc3Zm1DeEVCN1hoL2MyaXg3Q1hER0hqWE1OWVFsNVlNbEdWaWVWbTFKQkhWaUhXYlA4UE9JCmpEbUcvWDExZVczRFhoQ24yTFU1dlVOQTZKNUFQTmlBb0J5WU54VGhndDkvem5zZG0xL1dNZDQ5U0RGREVUcWkKeGhRWjlqQ2VNbXZFCi0tLS0tRU5EIENFUlRJRklDQVRFLS0tLS0K"

},

"platformVersion": "eks.44",

"tags": {

"karpenter.sh/discovery": "eksworkshop-eksctl",

"terraform-aws-modules": "eks",

"Blueprint": "eksworkshop-eksctl",

"GithubRepo": "github.com/aws-ia/terraform-aws-eks-blueprints"

},

"encryptionConfig": [

{

"resources": [

"secrets"

],

"provider": {

"keyArn": "arn:aws:kms:us-west-2:271345173787:key/6c3aafc1-dc99-4320-873f-5f5486f1b42a"

}

}

],

"health": {

"issues": []

},

"accessConfig": {

"authenticationMode": "API_AND_CONFIG_MAP"

},

"upgradePolicy": {

"supportType": "EXTENDED"

}

}

}[ 클러스터 기본정보 확인 ]

#

eksctl get cluster

NAME REGION EKSCTL CREATED

eksworkshop-eksctl us-west-2 False

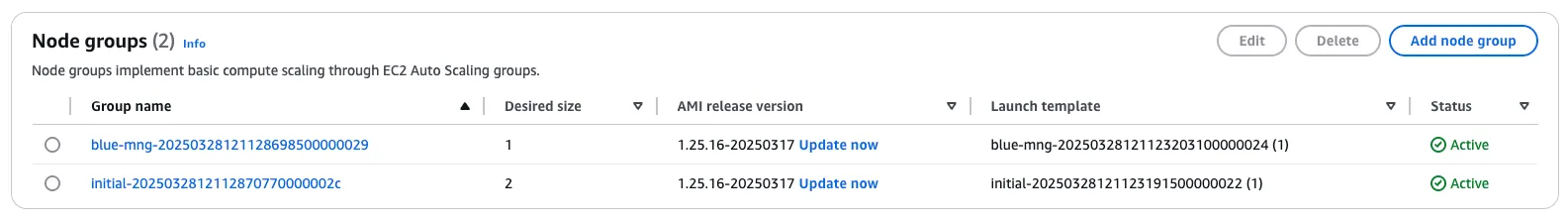

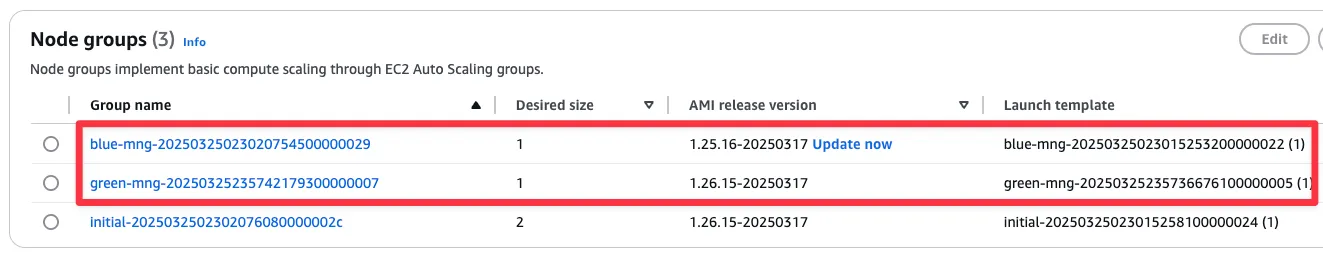

eksctl get nodegroup --cluster $CLUSTER_NAME

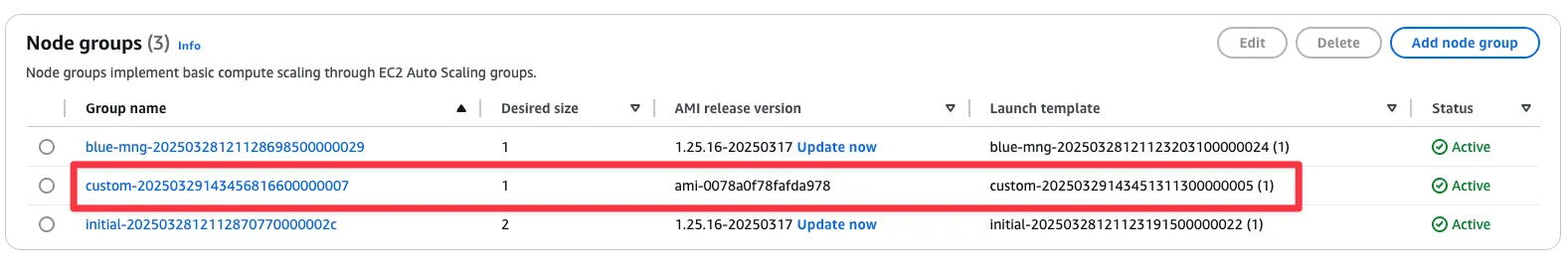

CLUSTER NODEGROUP STATUS CREATED MIN SIZE MAX SIZE DESIRED CAPACITY INSTANCE TYPE IMAGE ID ASG NAME TYPE

eksworkshop-eksctl blue-mng-20250325023020754500000029 ACTIVE 2025-03-25T02:30:22Z 1 2 1 m5.large,m6a.large,m6i.large AL2_x86_64 eks-blue-mng-20250325023020754500000029-00cae591-7abe-6143-dd33-c720df2700b6 managed

eksworkshop-eksctl initial-2025032502302076080000002c ACTIVE 2025-03-25T02:30:22Z 2 10 2 m5.large,m6a.large,m6i.large AL2_x86_64 eks-initial-2025032502302076080000002c-30cae591-7ac2-1e9c-2415-19975314b08b managed

eksctl get fargateprofile --cluster $CLUSTER_NAME

NAME SELECTOR_NAMESPACE SELECTOR_LABELS POD_EXECUTION_ROLE_ARN SUBNETS TAGS STATUS

fp-profile assets <none> arn:aws:iam::271345173787:role/fp-profile-2025032502301523520000001f subnet-0aeb12f673d69f7c5,subnet-047ab61ad85c50486,subnet-01bbd11a892aec6ee Blueprint=eksworkshop-eksctl,GithubRepo=github.com/aws-ia/terraform-aws-eks-blueprints,karpenter.sh/discovery=eksworkshop-eksctl ACTIVE

eksctl get addon --cluster $CLUSTER_NAME

NAME VERSION STATUS ISSUES IAMROLE UPDATE AVAILABLE CONFIGURATION VALUES

aws-ebs-csi-driver v1.41.0-eksbuild.1 ACTIVE 0 arn:aws:iam::271345173787:role/eksworkshop-eksctl-ebs-csi-driver-2025032502294618580000001d

coredns v1.8.7-eksbuild.10 ACTIVE 0 v1.9.3-eksbuild.22,v1.9.3-eksbuild.21,v1.9.3-eksbuild.19,v1.9.3-eksbuild.17,v1.9.3-eksbuild.15,v1.9.3-eksbuild.11,v1.9.3-eksbuild.10,v1.9.3-eksbuild.9,v1.9.3-eksbuild.7,v1.9.3-eksbuild.6,v1.9.3-eksbuild.5,v1.9.3-eksbuild.3,v1.9.3-eksbuild.2

kube-proxy v1.25.16-eksbuild.8 ACTIVE 0

vpc-cni v1.19.3-eksbuild.1 ACTIVE 0

#

kubectl get node --label-columns=eks.amazonaws.com/capacityType,node.kubernetes.io/lifecycle,karpenter.sh/capacity-type,eks.amazonaws.com/compute-type

NAME STATUS ROLES AGE VERSION CAPACITYTYPE LIFECYCLE CAPACITY-TYPE COMPUTE-TYPE

fargate-ip-10-0-41-147.us-west-2.compute.internal Ready <none> 135m v1.25.16-eks-2d5f260 fargate

ip-10-0-12-228.us-west-2.compute.internal Ready <none> 145m v1.25.16-eks-59bf375 ON_DEMAND

ip-10-0-26-119.us-west-2.compute.internal Ready <none> 145m v1.25.16-eks-59bf375 self-managed

ip-10-0-3-199.us-west-2.compute.internal Ready <none> 145m v1.25.16-eks-59bf375 ON_DEMAND

ip-10-0-39-95.us-west-2.compute.internal Ready <none> 135m v1.25.16-eks-59bf375 spot

ip-10-0-44-106.us-west-2.compute.internal Ready <none> 145m v1.25.16-eks-59bf375 ON_DEMAND

ip-10-0-6-184.us-west-2.compute.internal Ready <none> 145m v1.25.16-eks-59bf375 self-managed

kubectl get node -L eks.amazonaws.com/nodegroup,karpenter.sh/nodepool

NAME STATUS ROLES AGE VERSION NODEGROUP NODEPOOL

fargate-ip-10-0-41-147.us-west-2.compute.internal Ready <none> 154m v1.25.16-eks-2d5f260

ip-10-0-12-228.us-west-2.compute.internal Ready <none> 163m v1.25.16-eks-59bf375 initial-2025032502302076080000002c

ip-10-0-26-119.us-west-2.compute.internal Ready <none> 164m v1.25.16-eks-59bf375

ip-10-0-3-199.us-west-2.compute.internal Ready <none> 163m v1.25.16-eks-59bf375 blue-mng-20250325023020754500000029

ip-10-0-39-95.us-west-2.compute.internal Ready <none> 154m v1.25.16-eks-59bf375 default

ip-10-0-44-106.us-west-2.compute.internal Ready <none> 163m v1.25.16-eks-59bf375 initial-2025032502302076080000002c

ip-10-0-6-184.us-west-2.compute.internal Ready <none> 164m v1.25.16-eks-59bf375

kubectl get nodepools

k get NAME NODECLASS

default default

kubectl get nodeclaims -o yaml

kubectl get nodeclaims

NAME TYPE ZONE NODE READY AGE

default-rpl9w c5.xlarge us-west-2c ip-10-0-39-95.us-west-2.compute.internal True 155m

kubectl get node --label-columns=node.kubernetes.io/instance-type,kubernetes.io/arch,kubernetes.io/os,topology.kubernetes.io/zone

NAME STATUS ROLES AGE VERSION INSTANCE-TYPE ARCH OS ZONE

fargate-ip-10-0-41-147.us-west-2.compute.internal Ready <none> 136m v1.25.16-eks-2d5f260 amd64 linux us-west-2c

ip-10-0-12-228.us-west-2.compute.internal Ready <none> 146m v1.25.16-eks-59bf375 m5.large amd64 linux us-west-2a

ip-10-0-26-119.us-west-2.compute.internal Ready <none> 147m v1.25.16-eks-59bf375 m5.large amd64 linux us-west-2b

ip-10-0-3-199.us-west-2.compute.internal Ready <none> 146m v1.25.16-eks-59bf375 m5.large amd64 linux us-west-2a

ip-10-0-39-95.us-west-2.compute.internal Ready <none> 137m v1.25.16-eks-59bf375 c5.xlarge amd64 linux us-west-2c

ip-10-0-44-106.us-west-2.compute.internal Ready <none> 146m v1.25.16-eks-59bf375 m5.large amd64 linux us-west-2c

ip-10-0-6-184.us-west-2.compute.internal Ready <none> 147m v1.25.16-eks-59bf375 m5.large amd64 linux us-west-2a

#

kubectl cluster-info

Kubernetes control plane is running at https://B852364D70EA6D62672481D278A15059.gr7.us-west-2.eks.amazonaws.com

CoreDNS is running at https://B852364D70EA6D62672481D278A15059.gr7.us-west-2.eks.amazonaws.com/api/v1/namespaces/kube-system/services/kube-dns:dns/proxy

#

kubectl get nodes -owide

NAME STATUS ROLES AGE VERSION INTERNAL-IP EXTERNAL-IP OS-IMAGE KERNEL-VERSION CONTAINER-RUNTIME

fargate-ip-10-0-41-147.us-west-2.compute.internal Ready <none> 120m v1.25.16-eks-2d5f260 10.0.41.147 <none> Amazon Linux 2 5.10.234-225.910.amzn2.x86_64 containerd://1.7.25

ip-10-0-12-228.us-west-2.compute.internal Ready <none> 130m v1.25.16-eks-59bf375 10.0.12.228 <none> Amazon Linux 2 5.10.234-225.910.amzn2.x86_64 containerd://1.7.25

ip-10-0-26-119.us-west-2.compute.internal Ready <none> 130m v1.25.16-eks-59bf375 10.0.26.119 <none> Amazon Linux 2 5.10.230-223.885.amzn2.x86_64 containerd://1.7.23

ip-10-0-3-199.us-west-2.compute.internal Ready <none> 130m v1.25.16-eks-59bf375 10.0.3.199 <none> Amazon Linux 2 5.10.234-225.910.amzn2.x86_64 containerd://1.7.25

ip-10-0-39-95.us-west-2.compute.internal Ready <none> 120m v1.25.16-eks-59bf375 10.0.39.95 <none> Amazon Linux 2 5.10.230-223.885.amzn2.x86_64 containerd://1.7.23

ip-10-0-44-106.us-west-2.compute.internal Ready <none> 130m v1.25.16-eks-59bf375 10.0.44.106 <none> Amazon Linux 2 5.10.234-225.910.amzn2.x86_64 containerd://1.7.25

ip-10-0-6-184.us-west-2.compute.internal Ready <none> 130m v1.25.16-eks-59bf375 10.0.6.184 <none> Amazon Linux 2 5.10.230-223.885.amzn2.x86_64 containerd://1.7.23[ cluster & nodegroup 정보 확인 ]

#

kubectl get crd

NAME CREATED AT

applications.argoproj.io 2025-03-25T02:34:49Z

applicationsets.argoproj.io 2025-03-25T02:34:49Z

appprojects.argoproj.io 2025-03-25T02:34:49Z

cninodes.vpcresources.k8s.aws 2025-03-25T02:26:13Z

ec2nodeclasses.karpenter.k8s.aws 2025-03-25T02:35:15Z

eniconfigs.crd.k8s.amazonaws.com 2025-03-25T02:27:35Z

ingressclassparams.elbv2.k8s.aws 2025-03-25T02:35:15Z

nodeclaims.karpenter.sh 2025-03-25T02:35:15Z

nodepools.karpenter.sh 2025-03-25T02:35:16Z

policyendpoints.networking.k8s.aws 2025-03-25T02:26:13Z

securitygrouppolicies.vpcresources.k8s.aws 2025-03-25T02:26:13Z

targetgroupbindings.elbv2.k8s.aws 2025-03-25T02:35:15Z

helm list -A

NAME NAMESPACE REVISION UPDATED STATUS CHART APP VERSION

argo-cd argocd 1 2025-03-25 02:34:46.490919128 +0000 UTC deployed argo-cd-5.55.0 v2.10.0

aws-efs-csi-driver kube-system 1 2025-03-25 02:35:16.380271414 +0000 UTC deployed aws-efs-csi-driver-2.5.6 1.7.6

aws-load-balancer-controller kube-system 1 2025-03-25 02:35:17.147637895 +0000 UTC deployed aws-load-balancer-controller-1.7.1 v2.7.1

karpenter karpenter 1 2025-03-25 02:35:16.452581818 +0000 UTC deployed karpenter-0.37.0 0.37.0

metrics-server kube-system 1 2025-03-25 02:34:46.480366515 +0000 UTC deployed metrics-server-3.12.0 0.7.0

kubectl get applications -n argocd

NAME SYNC STATUS HEALTH STATUS

apps Synced Healthy

assets Synced Healthy

carts Synced Healthy

catalog Synced Healthy

checkout Synced Healthy

karpenter Synced Healthy

orders Synced Healthy

other Synced Healthy

rabbitmq Synced Healthy

ui OutOfSync Healthy

#

kubectl get pod -A

NAMESPACE NAME READY STATUS RESTARTS AGE

argocd argo-cd-argocd-application-controller-0 1/1 Running 0 146m

argocd argo-cd-argocd-applicationset-controller-74d9c9c5c7-6bsk8 1/1 Running 0 146m

argocd argo-cd-argocd-dex-server-6dbbd57479-h8r6b 1/1 Running 0 146m

argocd argo-cd-argocd-notifications-controller-fb4b954d5-lvp2z 1/1 Running 0 146m

argocd argo-cd-argocd-redis-76b4c599dc-5gj95 1/1 Running 0 146m

argocd argo-cd-argocd-repo-server-6b777b579d-thwrk 1/1 Running 0 146m

argocd argo-cd-argocd-server-86bdbd7b89-8t6f5 1/1 Running 0 146m

assets assets-7ccc84cb4d-s8wwb 1/1 Running 0 141m

carts carts-7ddbc698d8-zts9k 1/1 Running 0 141m

carts carts-dynamodb-6594f86bb9-8pzk5 1/1 Running 0 141m

catalog catalog-857f89d57d-9nfnw 1/1 Running 3 (140m ago) 141m

catalog catalog-mysql-0 1/1 Running 0 141m

checkout checkout-558f7777c-fs8dk 1/1 Running 0 141m

checkout checkout-redis-f54bf7cb5-whk4r 1/1 Running 0 141m

karpenter karpenter-547d656db9-qzfmm 1/1 Running 0 146m

karpenter karpenter-547d656db9-tsg8n 1/1 Running 0 146m

kube-system aws-load-balancer-controller-774bb546d8-pphh5 1/1 Running 0 145m

kube-system aws-load-balancer-controller-774bb546d8-r7k45 1/1 Running 0 145m

kube-system aws-node-6xgbd 2/2 Running 0 140m

kube-system aws-node-j5qzk 2/2 Running 0 145m

kube-system aws-node-mvg22 2/2 Running 0 145m

kube-system aws-node-pnx48 2/2 Running 0 145m

kube-system aws-node-sh8lt 2/2 Running 0 145m

kube-system aws-node-z7g8q 2/2 Running 0 145m

kube-system coredns-98f76fbc4-4wz5j 1/1 Running 0 145m

kube-system coredns-98f76fbc4-k4wnz 1/1 Running 0 145m

kube-system ebs-csi-controller-6b575b5f4d-dqdqp 6/6 Running 0 145m

kube-system ebs-csi-controller-6b575b5f4d-wwc7q 6/6 Running 0 145m

kube-system ebs-csi-node-72rl8 3/3 Running 0 145m

kube-system ebs-csi-node-g6cn4 3/3 Running 0 145m

kube-system ebs-csi-node-jvrwj 3/3 Running 0 145m

kube-system ebs-csi-node-jwndw 3/3 Running 0 145m

kube-system ebs-csi-node-qqmsh 3/3 Running 0 145m

kube-system ebs-csi-node-qwpf5 3/3 Running 0 140m

kube-system efs-csi-controller-5d74ddd947-97ncr 3/3 Running 0 146m

kube-system efs-csi-controller-5d74ddd947-mzkqd 3/3 Running 0 146m

kube-system efs-csi-node-69hzl 3/3 Running 0 140m

kube-system efs-csi-node-6k8g2 3/3 Running 0 146m

kube-system efs-csi-node-8hvhz 3/3 Running 0 146m

kube-system efs-csi-node-9fnxz 3/3 Running 0 146m

kube-system efs-csi-node-gb2xm 3/3 Running 0 146m

kube-system efs-csi-node-rcggq 3/3 Running 0 146m

kube-system kube-proxy-6b9vq 1/1 Running 0 145m

kube-system kube-proxy-6lqcc 1/1 Running 0 145m

kube-system kube-proxy-9x46z 1/1 Running 0 145m

kube-system kube-proxy-k26rj 1/1 Running 0 145m

kube-system kube-proxy-xk9tc 1/1 Running 0 145m

kube-system kube-proxy-xvh4j 1/1 Running 0 140m

kube-system metrics-server-785cd745cd-c57q7 1/1 Running 0 146m

orders orders-5b97745747-mxg72 1/1 Running 2 (140m ago) 141m

orders orders-mysql-b9b997d9d-2p8pn 1/1 Running 0 141m

rabbitmq rabbitmq-0 1/1 Running 0 141m

ui ui-5dfb7d65fc-9vgt9 1/1 Running 0 141m

#

kubectl get pdb -A

NAMESPACE NAME MIN AVAILABLE MAX UNAVAILABLE ALLOWED DISRUPTIONS AGE

karpenter karpenter N/A 1 1 145m

kube-system aws-load-balancer-controller N/A 1 1 145m

kube-system coredns N/A 1 1 153m

kube-system ebs-csi-controller N/A 1 1 145m

#

kubectl get svc -n argocd argo-cd-argocd-server

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

argo-cd-argocd-server LoadBalancer 172.20.10.210 k8s-argocd-argocdar-eb7166e616-ed2069d8c15177c9.elb.us-west-2.amazonaws.com 80:32065/TCP,443:31156/TCP 150m

kubectl get targetgroupbindings -n argocd

NAME SERVICE-NAME SERVICE-PORT TARGET-TYPE AGE

k8s-argocd-argocdar-9c77afbc38 argo-cd-argocd-server 443 ip 153m

k8s-argocd-argocdar-efa4621491 argo-cd-argocd-server 80 ip 153m

# 노드에 taint 정보 확인

kubectl get nodes -o custom-columns='NODE:.metadata.name,TAINTS:.spec.taints[*].key,VALUES:.spec.taints[*].value,EFFECTS:.spec.taints[*].effect'

NODE TAINTS VALUES EFFECTS

fargate-ip-10-0-2-38.us-west-2.compute.internal eks.amazonaws.com/compute-type fargate NoSchedule

ip-10-0-0-72.us-west-2.compute.internal dedicated CheckoutApp NoSchedule

ip-10-0-13-217.us-west-2.compute.internal <none> <none> <none>

ip-10-0-28-252.us-west-2.compute.internal <none> <none> <none>

ip-10-0-3-168.us-west-2.compute.internal dedicated OrdersApp NoSchedule

ip-10-0-40-107.us-west-2.compute.internal <none> <none> <none>

ip-10-0-42-84.us-west-2.compute.internal <none> <none> <none>

#

kubectl get node -L eks.amazonaws.com/nodegroup,karpenter.sh/nodepool

NAME STATUS ROLES AGE VERSION NODEGROUP NODEPOOL

fargate-ip-10-0-2-38.us-west-2.compute.internal Ready <none> 16h v1.25.16-eks-2d5f260

ip-10-0-0-72.us-west-2.compute.internal Ready <none> 16h v1.25.16-eks-59bf375 default

ip-10-0-13-217.us-west-2.compute.internal Ready <none> 16h v1.25.16-eks-59bf375 initial-2025032812112870770000002c

ip-10-0-28-252.us-west-2.compute.internal Ready <none> 16h v1.25.16-eks-59bf375

ip-10-0-3-168.us-west-2.compute.internal Ready <none> 16h v1.25.16-eks-59bf375 blue-mng-20250328121128698500000029

ip-10-0-40-107.us-west-2.compute.internal Ready <none> 16h v1.25.16-eks-59bf375

ip-10-0-42-84.us-west-2.compute.internal Ready <none> 16h v1.25.16-eks-59bf375 initial-2025032812112870770000002c

# 노드 별 label 확인

kubectl get nodes -o json | jq '.items[] | {name: .metadata.name, labels: .metadata.labels}'

...

{

"name": "ip-10-0-0-72.us-west-2.compute.internal",

"labels": {

"beta.kubernetes.io/arch": "amd64",

"beta.kubernetes.io/instance-type": "m5.large",

"beta.kubernetes.io/os": "linux",

"env": "dev",

...

#

kubectl get sts -A

NAMESPACE NAME READY AGE

argocd argo-cd-argocd-application-controller 1/1 150m

catalog catalog-mysql 1/1 145m

rabbitmq rabbitmq 1/1 145m

#

kubectl get sc

NAME PROVISIONER RECLAIMPOLICY VOLUMEBINDINGMODE ALLOWVOLUMEEXPANSION AGE

efs efs.csi.aws.com Delete Immediate true 152m

gp2 kubernetes.io/aws-ebs Delete WaitForFirstConsumer false 163m

gp3 (default) ebs.csi.aws.com Delete WaitForFirstConsumer true 152m

kubectl describe sc efs

...

Provisioner: efs.csi.aws.com

Parameters: basePath=/dynamic_provisioning,directoryPerms=755,ensureUniqueDirectory=false,fileSystemId=fs-0b269b8e2735b9c59,gidRangeEnd=200,gidRangeStart=100,provisioningMode=efs-ap,reuseAccessPoint=false,subPathPattern=${.PVC.namespace}/${.PVC.name}

AllowVolumeExpansion: True

...

#

kubectl get pv,pvc -A

NAME CAPACITY ACCESS MODES RECLAIM POLICY STATUS CLAIM STORAGECLASS REASON AGE

persistentvolume/pvc-7aa7d213-892d-4f79-bf90-a530d648ff63 4Gi RWO Delete Bound catalog/catalog-mysql-pvc gp3 146m

persistentvolume/pvc-875d1ca7-e28b-421a-8a7e-2ae9d7480b9a 4Gi RWO Delete Bound orders/order-mysql-pvc gp3 146m

persistentvolume/pvc-b612df9f-bb9d-4b82-a973-fe40360c2ef5 4Gi RWO Delete Bound checkout/checkout-redis-pvc gp3 145m

NAMESPACE NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE

catalog persistentvolumeclaim/catalog-mysql-pvc Bound pvc-7aa7d213-892d-4f79-bf90-a530d648ff63 4Gi RWO gp3 146m

checkout persistentvolumeclaim/checkout-redis-pvc Bound pvc-b612df9f-bb9d-4b82-a973-fe40360c2ef5 4Gi RWO gp3 146m

orders persistentvolumeclaim/order-mysql-pvc Bound pvc-875d1ca7-e28b-421a-8a7e-2ae9d7480b9a 4Gi RWO gp3 146m[ access entry 및 IAM Roll 매핑정보 확인 ]

#

aws eks list-access-entries --cluster-name $CLUSTER_NAME

{

"accessEntries": [

"arn:aws:iam::271345173787:role/aws-service-role/eks.amazonaws.com/AWSServiceRoleForAmazonEKS",

"arn:aws:iam::271345173787:role/blue-mng-eks-node-group-20250325022024229600000010",

"arn:aws:iam::271345173787:role/default-selfmng-node-group-2025032502202377680000000e",

"arn:aws:iam::271345173787:role/fp-profile-2025032502301523520000001f",

"arn:aws:iam::271345173787:role/initial-eks-node-group-2025032502202398930000000f",

"arn:aws:iam::271345173787:role/karpenter-eksworkshop-eksctl",

"arn:aws:iam::271345173787:role/workshop-stack-IdeIdeRoleD654ADD4-Qhv1nLkOGItJ"

]

}

#

eksctl get iamidentitymapping --cluster $CLUSTER_NAME

ARN USERNAME GROUPS ACCOUNT

arn:aws:iam::271345173787:role/WSParticipantRole admin system:masters

arn:aws:iam::271345173787:role/blue-mng-eks-node-group-20250325022024229600000010 system:node:{{EC2PrivateDNSName}} system:bootstrappers,system:nodes

arn:aws:iam::271345173787:role/fp-profile-2025032502301523520000001f system:node:{{SessionName}} system:bootstrappers,system:nodes,system:node-proxier

arn:aws:iam::271345173787:role/initial-eks-node-group-2025032502202398930000000f system:node:{{EC2PrivateDNSName}} system:bootstrappers,system:nodes

arn:aws:iam::271345173787:role/workshop-stack-IdeIdeRoleD654ADD4-Qhv1nLkOGItJ admin system:masters

#

kubectl describe cm -n kube-system aws-auth

...

mapRoles:

----

- groups:

- system:bootstrappers

- system:nodes

rolearn: arn:aws:iam::271345173787:role/blue-mng-eks-node-group-20250325022024229600000010

username: system:node:{{EC2PrivateDNSName}}

- groups:

- system:bootstrappers

- system:nodes

rolearn: arn:aws:iam::271345173787:role/initial-eks-node-group-2025032502202398930000000f

username: system:node:{{EC2PrivateDNSName}}

- groups:

- system:bootstrappers

- system:nodes

- system:node-proxier

rolearn: arn:aws:iam::271345173787:role/fp-profile-2025032502301523520000001f

username: system:node:{{SessionName}}

- groups:

- system:masters

rolearn: arn:aws:iam::271345173787:role/WSParticipantRole

username: admin

- groups:

- system:masters

rolearn: arn:aws:iam::271345173787:role/workshop-stack-IdeIdeRoleD654ADD4-Qhv1nLkOGItJ

username: admin

...

# IRSA : karpenter, alb-controller, ebs-csi-driver, aws-efs-csi-driver 4곳에서 사용

eksctl get iamserviceaccount --cluster $CLUSTER_NAME

kubectl describe sa -A | grep role-arn

Annotations: eks.amazonaws.com/role-arn: arn:aws:iam::363835126563:role/karpenter-2025032812153665450000003a

Annotations: eks.amazonaws.com/role-arn: arn:aws:iam::363835126563:role/alb-controller-20250328121536592300000039

Annotations: eks.amazonaws.com/role-arn: arn:aws:iam::363835126563:role/eksworkshop-eksctl-ebs-csi-driver-2025032812105428630000001d

Annotations: eks.amazonaws.com/role-arn: arn:aws:iam::363835126563:role/aws-efs-csi-driver-2025032812153665870000003b

Annotations: eks.amazonaws.com/role-arn: arn:aws:iam::363835126563:role/aws-efs-csi-driver-2025032812153665870000003b

# pod identity 없음

eksctl get podidentityassociation --cluster $CLUSTER_NAME

# EKS API Endpoint

aws eks describe-cluster --name $CLUSTER_NAME | jq -r .cluster.endpoint | cut -d '/' -f 3

B852364D70EA6D62672481D278A15059.gr7.us-west-2.eks.amazonaws.com

dig +short $APIDNS

35.163.123.202

44.246.155.206

# OIDC

aws eks describe-cluster --name $CLUSTER_NAME --query cluster.identity.oidc.issuer --output text

https://oidc.eks.us-west-2.amazonaws.com/id/B852364D70EA6D62672481D278A15059

aws iam list-open-id-connect-providers | jq

{

"OpenIDConnectProviderList": [

{

"Arn": "arn:aws:iam::363835126563:oidc-provider/oidc.eks.us-west-2.amazonaws.com/id/B852364D70EA6D62672481D278A15059"

}

]

}

* Blue-Green 업그레이드 시, IRSA (OpenID Connector provider URL) 도 변경된다!!

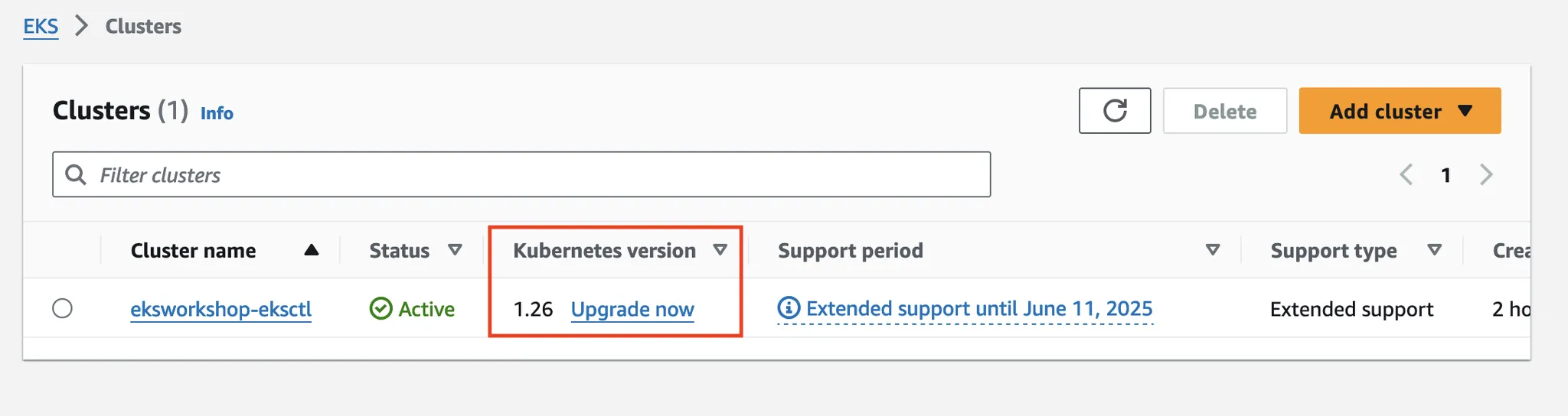

Step3. AWS 관리 콘솔 접속 : EKS, EC2, VPC 등 확인

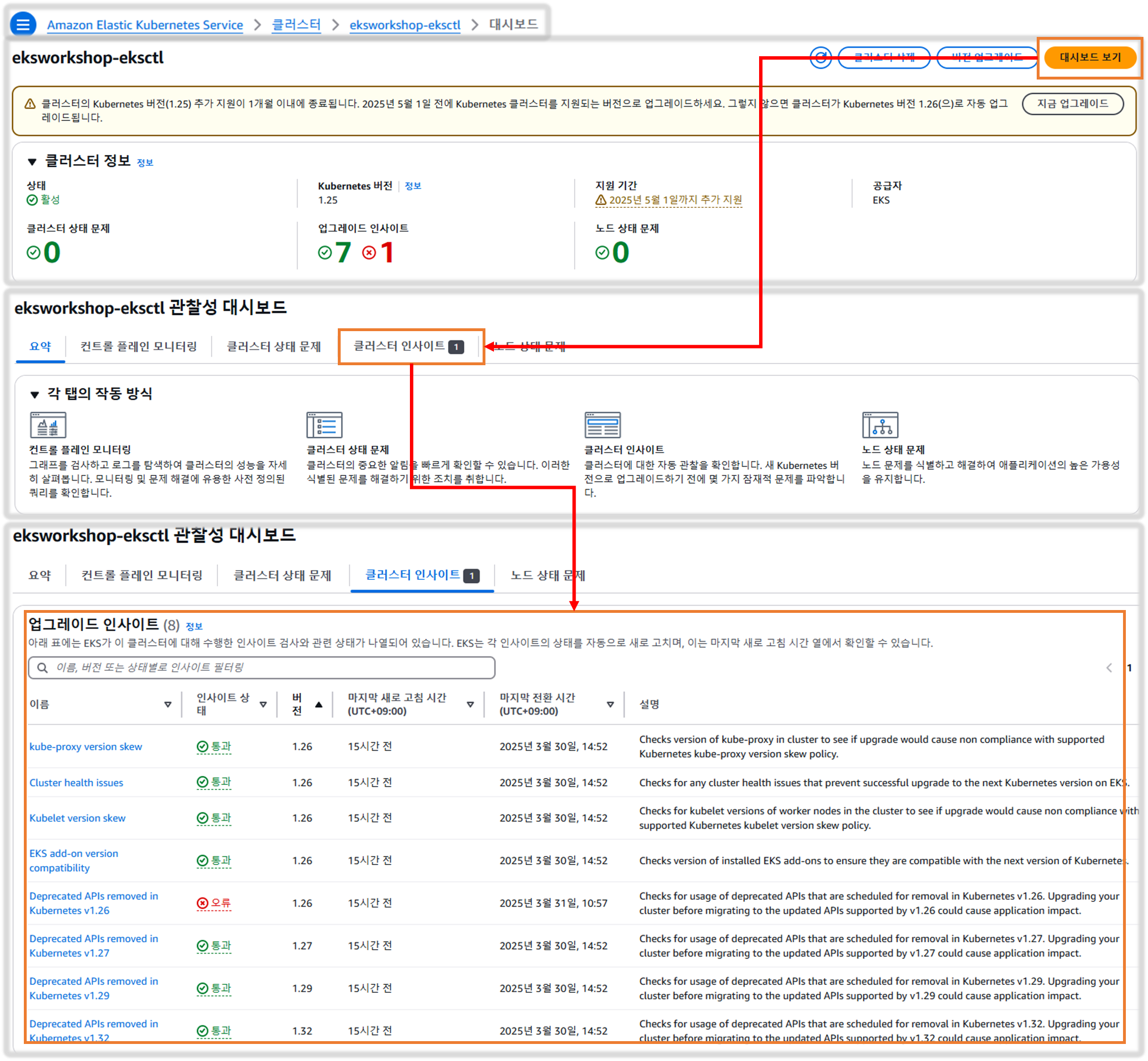

☞ EKS > Compute / Add-on

☞ EKS - Upgrade version : 상위 1개 마이너 버전 업그레이드만 가능. 실제 수행은 하지 말것!

☞ EKS - Dashboard - Cluster insights : Deprecated APIs remove in Kubernetes 1.26 클릭 상세 확인

☞ EC2 : IDE-Server 제외한, (워커) 노드 6대 EC2 확인 ← 참고로 fargate node(MicroVM) 1대 기동 중

☞ EC2 - LB : ArgoCD 외부 접속용 NLB 확인

☞ EC2 - ASG : 3개의 ASG 확인 - blug-mng 관리 노드는 AZ1 곳만 사용 중(us-west-2a)

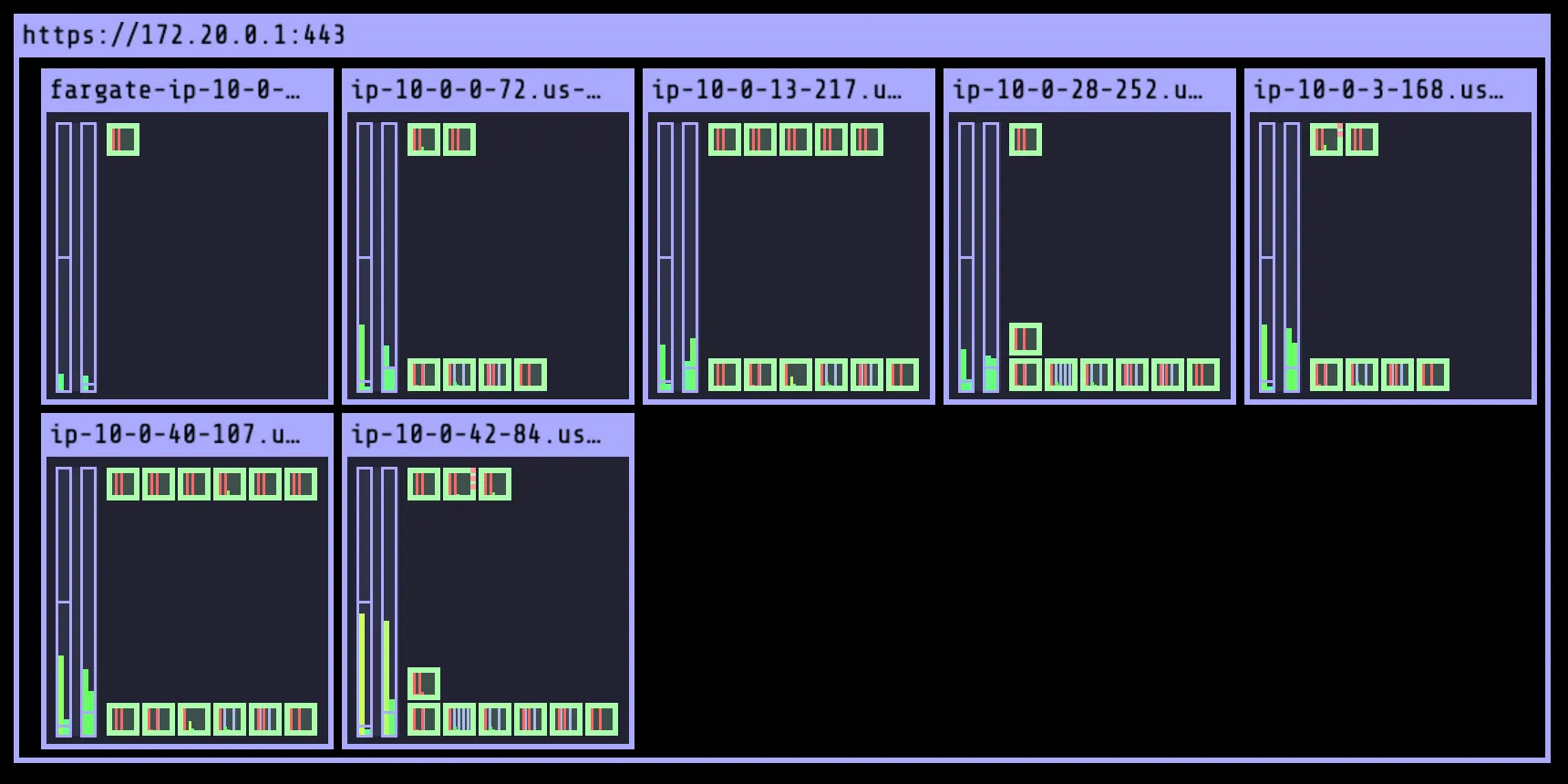

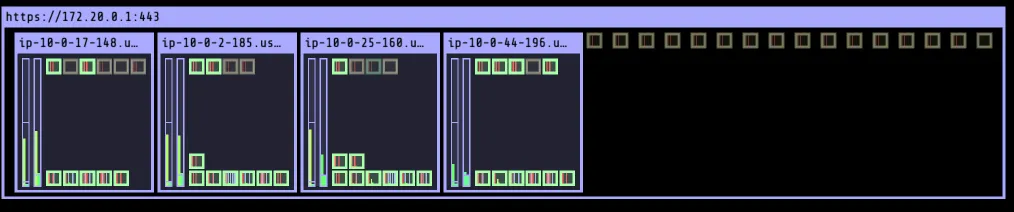

Step4. (추가) 실습 편리 설정 : kube-ops-view , krew , eks-node-view , k9s

1. Kube-OpsView 설치

# kube-ops-view

helm repo add geek-cookbook https://geek-cookbook.github.io/charts/

helm repo update

helm install kube-ops-view geek-cookbook/kube-ops-view --version 1.2.2 --namespace kube-system

#

cat <<EOF | kubectl apply -f -

apiVersion: v1

kind: Service

metadata:

annotations:

service.beta.kubernetes.io/aws-load-balancer-nlb-target-type: ip

service.beta.kubernetes.io/aws-load-balancer-scheme: internet-facing

service.beta.kubernetes.io/aws-load-balancer-type: external

labels:

app.kubernetes.io/instance: kube-ops-view

app.kubernetes.io/name: kube-ops-view

name: kube-ops-view-nlb

namespace: kube-system

spec:

type: LoadBalancer

ports:

- name: http

port: 80

protocol: TCP

targetPort: 8080

selector:

app.kubernetes.io/instance: kube-ops-view

app.kubernetes.io/name: kube-ops-view

EOF

# kube-ops-view 접속 URL 확인 (1.5, 1.3 배율)

kubectl get svc -n kube-system kube-ops-view-nlb -o jsonpath='{.status.loadBalancer.ingress[0].hostname}' | awk '{ print "KUBE-OPS-VIEW URL = http://"$1"/#scale=1.5"}'

kubectl get svc -n kube-system kube-ops-view-nlb -o jsonpath='{.status.loadBalancer.ingress[0].hostname}' | awk '{ print "KUBE-OPS-VIEW URL = http://"$1"/#scale=1.3"}'

2. krew 설치

# 설치

(

set -x; cd "$(mktemp -d)" &&

OS="$(uname | tr '[:upper:]' '[:lower:]')" &&

ARCH="$(uname -m | sed -e 's/x86_64/amd64/' -e 's/\(arm\)\(64\)\?.*/\1\2/' -e 's/aarch64$/arm64/')" &&

KREW="krew-${OS}_${ARCH}" &&

curl -fsSLO "https://github.com/kubernetes-sigs/krew/releases/latest/download/${KREW}.tar.gz" &&

tar zxvf "${KREW}.tar.gz" &&

./"${KREW}" install krew

)

# PATH

export PATH="${KREW_ROOT:-$HOME/.krew}/bin:$PATH"

vi ~/.bashrc

-----------

export PATH="${KREW_ROOT:-$HOME/.krew}/bin:$PATH"

-----------

# 플러그인 설치

kubectl krew install ctx ns df-pv get-all neat stern oomd whoami rbac-tool rolesum

kubectl krew list

#

kubectl df-pv

#

kubectl whoami --all

User: admin

Groups:

system:masters

system:authenticated

ARN:

arn:aws:sts::363835126563:assumed-role/workshop-stack-IdeIdeRoleD654ADD4-nSApoLMDr5GW/i-00d9a1ac022bd4f29

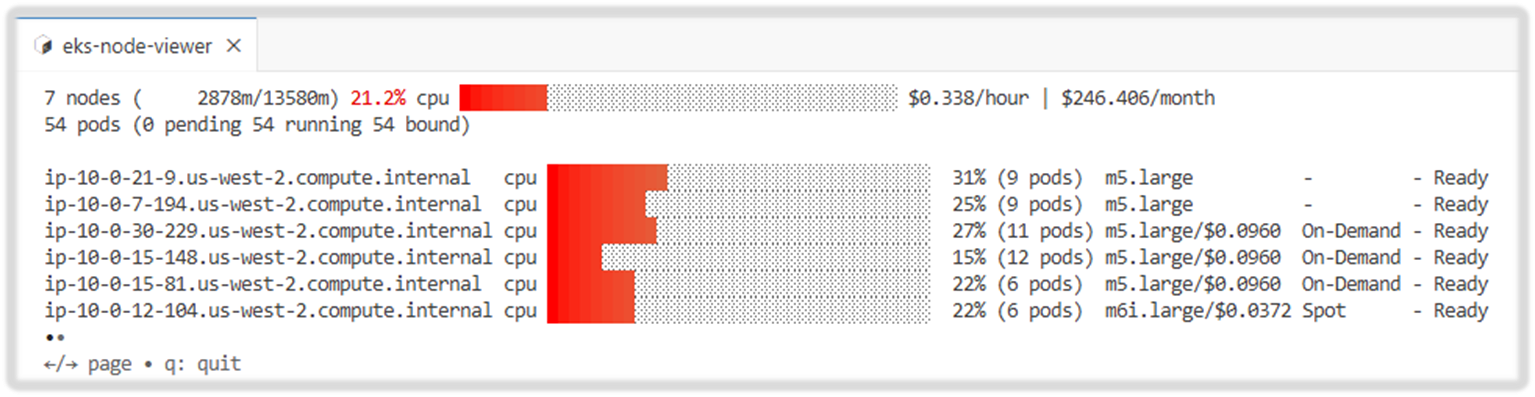

3. eks-node-view

# 설치

wget -O eks-node-viewer https://github.com/awslabs/eks-node-viewer/releases/download/v0.7.1/eks-node-viewer_Linux_x86_64

chmod +x eks-node-viewer

sudo mv -v eks-node-viewer /usr/local/bin

# Standard usage : self-mng 노드는 가격 미출력됨.

eks-node-viewer

ip-10-0-40-107.us-west-2.compute.internal cpu ██████████░░░░░░░░░░░░░░░░░░░░░░░░░ 27% (12 pods) m5.large - - Ready

ip-10-0-28-252.us-west-2.compute.internal cpu ████░░░░░░░░░░░░░░░░░░░░░░░░░░░░░░░ 12% (8 pods) m5.large - - Ready

ip-10-0-3-168.us-west-2.compute.internal cpu ████████░░░░░░░░░░░░░░░░░░░░░░░░░░░ 22% (6 pods) m5.large/$0.0960 On-Demand - Ready

ip-10-0-13-217.us-west-2.compute.internal cpu █████░░░░░░░░░░░░░░░░░░░░░░░░░░░░░░ 15% (11 pods) m5.large/$0.0960 On-Demand - Ready

ip-10-0-42-84.us-west-2.compute.internal cpu ███████████████░░░░░░░░░░░░░░░░░░░░ 44% (10 pods) m5.large/$0.0960 On-Demand - Ready

ip-10-0-0-72.us-west-2.compute.internal cpu ████████░░░░░░░░░░░░░░░░░░░░░░░░░░░ 22% (6 pods) m5.large/$0.0378 Spot - Ready

fargate-ip-10-0-2-38.us-west-2.compute.internal cpu ██░░░░░░░░░░░░░░░░░░░░░░░░░░░░░░░░░ 6% (1 pods) 0.25vCPU-0.5GB/$0.0123 Fargate - Ready

kubectl get node --label-columns=eks.amazonaws.com/capacityType,node.kubernetes.io/lifecycle,karpenter.sh/capacity-type,eks.amazonaws.com/compute-type

NAME STATUS ROLES AGE VERSION CAPACITYTYPE LIFECYCLE CAPACITY-TYPE COMPUTE-TYPE

fargate-ip-10-0-2-38.us-west-2.compute.internal Ready <none> 18h v1.25.16-eks-2d5f260 fargate

ip-10-0-0-72.us-west-2.compute.internal Ready <none> 18h v1.25.16-eks-59bf375 spot

ip-10-0-13-217.us-west-2.compute.internal Ready <none> 18h v1.25.16-eks-59bf375 ON_DEMAND

ip-10-0-28-252.us-west-2.compute.internal Ready <none> 18h v1.25.16-eks-59bf375 self-managed

ip-10-0-3-168.us-west-2.compute.internal Ready <none> 18h v1.25.16-eks-59bf375 ON_DEMAND

ip-10-0-40-107.us-west-2.compute.internal Ready <none> 18h v1.25.16-eks-59bf375 self-managed

ip-10-0-42-84.us-west-2.compute.internal Ready <none> 18h v1.25.16-eks-59bf375 ON_DEMAND

# Display both CPU and Memory Usage

eks-node-viewer --resources cpu,memory

eks-node-viewer --resources cpu,memory --extra-labels eks-node-viewer/node-age

# Display extra labels, i.e. AZ : node 에 labels 사용 가능

eks-node-viewer --extra-labels topology.kubernetes.io/zone

eks-node-viewer --extra-labels kubernetes.io/arch

# Sort by CPU usage in descending order

eks-node-viewer --node-sort=eks-node-viewer/node-cpu-usage=dsc

# Karenter nodes only

eks-node-viewer --node-selector "karpenter.sh/provisioner-name"

# Specify a particular AWS profile and region

AWS_PROFILE=myprofile AWS_REGION=us-west-2

Computed Labels : --extra-labels

# eks-node-viewer/node-age - Age of the node

eks-node-viewer --extra-labels eks-node-viewer/node-age

eks-node-viewer --extra-labels topology.kubernetes.io/zone,eks-node-viewer/node-age

# eks-node-viewer/node-ephemeral-storage-usage - Ephemeral Storage usage (requests)

eks-node-viewer --extra-labels eks-node-viewer/node-ephemeral-storage-usage

# eks-node-viewer/node-cpu-usage - CPU usage (requests)

eks-node-viewer --extra-labels eks-node-viewer/node-cpu-usage

# eks-node-viewer/node-memory-usage - Memory usage (requests)

eks-node-viewer --extra-labels eks-node-viewer/node-memory-usage

# eks-node-viewer/node-pods-usage - Pod usage (requests)

eks-node-viewer --extra-labels eks-node-viewer/node-pods-usage

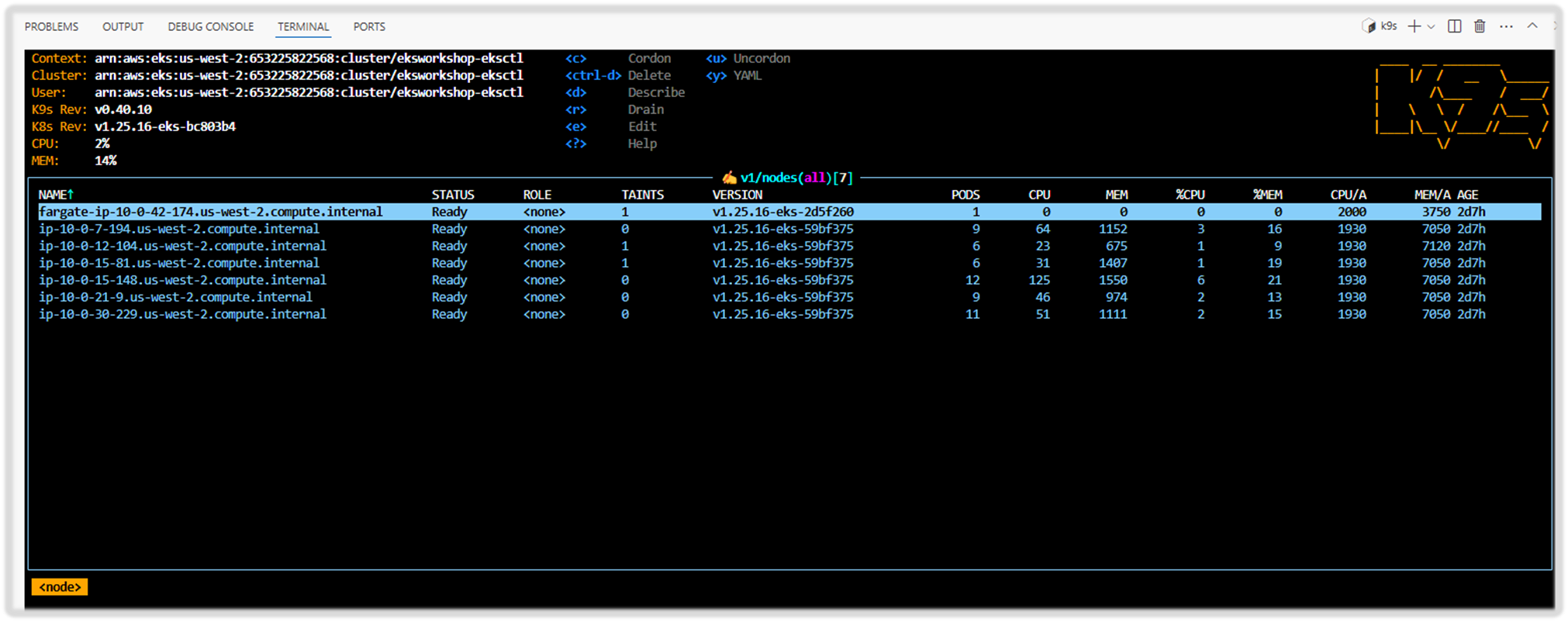

4. k9s

#

curl -sS https://webinstall.dev/k9s | bash

k9s version

#

k9s

Step5. 실습 환경 배포한 테라폼 파일 확인 : 업그레이드 작업에서 사용 예정

# 파일 확인

ec2-user:~/environment:$ ls -lrt terraform/

total 40

-rw-r--r--. 1 ec2-user ec2-user 625 Aug 27 2024 vpc.tf

-rw-r--r--. 1 ec2-user ec2-user 542 Aug 27 2024 versions.tf

-rw-r--r--. 1 ec2-user ec2-user 353 Aug 27 2024 variables.tf

-rw-r--r--. 1 ec2-user ec2-user 282 Aug 27 2024 outputs.tf

-rw-r--r--. 1 ec2-user ec2-user 1291 Aug 27 2024 gitops-setup.tf

-rw-r--r--. 1 ec2-user ec2-user 4512 Feb 5 01:15 base.tf

-rw-r--r--. 1 ec2-user ec2-user 5953 Feb 13 19:55 addons.tf

-rw-r--r--. 1 ec2-user ec2-user 33 Mar 25 02:26 backend_override.tf

# 해당 경로에 tfstate 파일은 없다.

ec2-user:~/environment/terraform:$ terraform output

╷

│ Warning: No outputs found

#

aws s3 ls

2025-03-28 11:56:25 workshop-stack-tfstatebackendbucketf0fc9a9d-wt2fbt9qjdpc

aws s3 ls s3://workshop-stack-tfstatebackendbucketf0fc9a9d-wt2fbt9qjdpc

2025-03-28 12:18:23 940996 terraform.tfstate

# (옵션) terraform.tfstate 복사 후 IDE-Server 에서 terraform.tfstate 열어보기

aws s3 cp s3://workshop-stack-tfstatebackendbucketf0fc9a9d-wt2fbt9qjdpc/terraform.tfstate .

# backend_override.tf 수정

terraform {

backend "s3" {

bucket = "workshop-stack-tfstatebackendbucketf0fc9a9d-shrn1gryae5i"

region = "us-west-2"

key = "terraform.tfstate"

}

}

# 확인

terraform state list

terrafor

▶ vpc.tf

module "vpc" {

source = "terraform-aws-modules/vpc/aws"

version = "~> 5.0"

name = local.name

cidr = local.vpc_cidr

azs = local.azs

private_subnets = [for k, v in local.azs : cidrsubnet(local.vpc_cidr, 4, k)]

public_subnets = [for k, v in local.azs : cidrsubnet(local.vpc_cidr, 8, k + 48)]

enable_nat_gateway = true

single_nat_gateway = true

public_subnet_tags = {

"kubernetes.io/role/elb" = 1

}

private_subnet_tags = {

"kubernetes.io/role/internal-elb" = 1

# Tags subnets for Karpenter auto-discovery

"karpenter.sh/discovery" = local.name

}

tags = local.tags

}

▶ versions.tf

terraform {

required_version = ">= 1.3"

required_providers {

aws = {

source = "hashicorp/aws"

version = ">= 5.34"

}

helm = {

source = "hashicorp/helm"

version = ">= 2.9"

}

kubernetes = {

source = "hashicorp/kubernetes"

version = ">= 2.20"

}

}

# ## Used for end-to-end testing on project; update to suit your needs

# backend "s3" {

# bucket = "terraform-ssp-github-actions-state"

# region = "us-west-2"

# key = "e2e/karpenter/terraform.tfstate"

# }

}

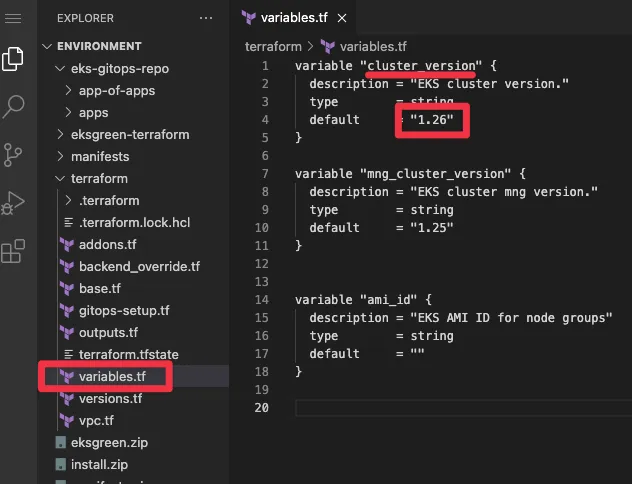

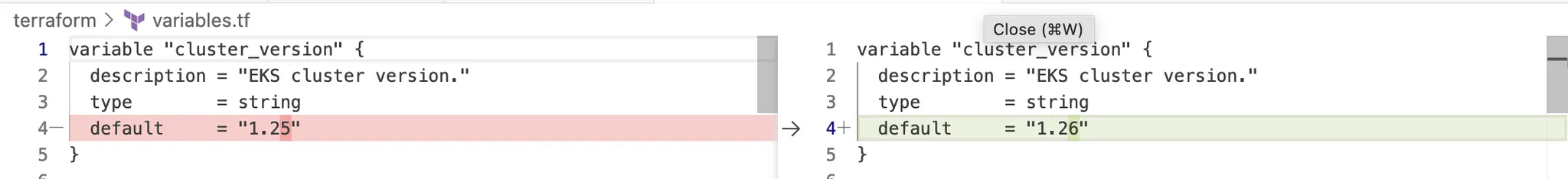

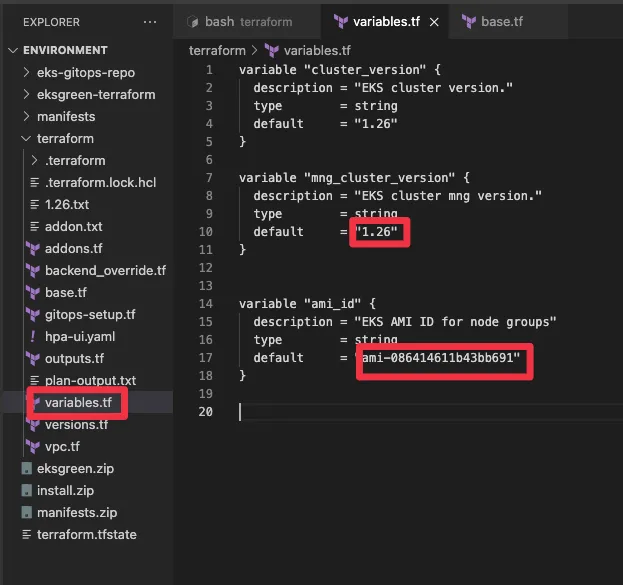

▶ variables.tf : eks 버전(1.25), mng(1.25)

variable "cluster_version" {

description = "EKS cluster version."

type = string

default = "1.25"

}

variable "mng_cluster_version" {

description = "EKS cluster mng version."

type = string

default = "1.25"

}

variable "ami_id" {

description = "EKS AMI ID for node groups"

type = string

default = ""

}

▶ outputs.tf

output "configure_kubectl" {

description = "Configure kubectl: make sure you're logged in with the correct AWS profile and run the following command to update your kubeconfig"

value = "aws eks --region ${local.region} update-kubeconfig --name ${module.eks.cluster_name}"

}▶ gitops-setup.tf : aws_codecommit (Private Git Repo, 관리형 소스 제어 서비스) - Link

resource "aws_codecommit_repository" "gitops_repo_cc" {

repository_name = "eks-gitops-repo"

default_branch = "main"

}

resource "aws_iam_user" "argocd_user" {

name = "argocd-user"

}

resource "aws_iam_service_specific_credential" "argocd_codecommit_credential" {

service_name = "codecommit.amazonaws.com"

user_name = aws_iam_user.argocd_user.name

}

resource "aws_iam_user_policy" "argocd_user_codecommit_rw" {

name = "argocd-user-codecommit-ro"

user = aws_iam_user.argocd_user.name

policy = jsonencode({

Version : "2012-10-17",

Statement : [

{

Effect : "Allow",

Action : "codecommit:*",

Resource : aws_codecommit_repository.gitops_repo_cc.arn

}

]

})

}

resource "aws_secretsmanager_secret" "argocd_user_creds_secret" {

name = "argocd-user-creds"

}

resource "aws_secretsmanager_secret_version" "argocd_user_creds_secret_version" {

secret_id = aws_secretsmanager_secret.argocd_user_creds_secret.id

secret_string = jsonencode({

url = "${aws_codecommit_repository.gitops_repo_cc.clone_url_http}"

username = "${aws_iam_service_specific_credential.argocd_codecommit_credential.service_user_name}"

password = "${aws_iam_service_specific_credential.argocd_codecommit_credential.service_password}"

})

}▶ base.tf

provider "aws" {

region = local.region

}

# Required for public ECR where Karpenter artifacts are hosted

provider "aws" {

region = "us-east-1"

alias = "virginia"

}

provider "kubernetes" {

host = module.eks.cluster_endpoint

cluster_ca_certificate = base64decode(module.eks.cluster_certificate_authority_data)

exec {

api_version = "client.authentication.k8s.io/v1beta1"

command = "aws"

# This requires the awscli to be installed locally where Terraform is executed

args = ["eks", "get-token", "--cluster-name", module.eks.cluster_name]

}

}

provider "helm" {

kubernetes {

host = module.eks.cluster_endpoint

cluster_ca_certificate = base64decode(module.eks.cluster_certificate_authority_data)

exec {

api_version = "client.authentication.k8s.io/v1beta1"

command = "aws"

# This requires the awscli to be installed locally where Terraform is executed

args = ["eks", "get-token", "--cluster-name", module.eks.cluster_name]

}

}

}

data "aws_partition" "current" {}

data "aws_caller_identity" "current" {}

data "aws_ecrpublic_authorization_token" "token" {

provider = aws.virginia

}

data "aws_availability_zones" "available" {}

# tflint-ignore: terraform_unused_declarations

variable "eks_cluster_id" {

description = "EKS cluster name"

type = string

}

variable "aws_region" {

description = "AWS Region"

type = string

}

locals {

name = var.eks_cluster_id

region = var.aws_region

vpc_cidr = "10.0.0.0/16"

azs = slice(data.aws_availability_zones.available.names, 0, 3)

tags = {

Blueprint = local.name

GithubRepo = "github.com/aws-ia/terraform-aws-eks-blueprints"

}

}

################################################################################

# Cluster

################################################################################

module "eks" {

source = "terraform-aws-modules/eks/aws"

version = "~> 20.14"

cluster_name = local.name

cluster_version = var.cluster_version

cluster_endpoint_public_access = true

vpc_id = module.vpc.vpc_id

subnet_ids = module.vpc.private_subnets

# Fargate profiles use the cluster primary security group so these are not utilized

# create_cluster_security_group = false

# create_node_security_group = false

enable_cluster_creator_admin_permissions = true

fargate_profiles = {

fp-profile = {

selectors = [

{ namespace = "assets" }

]

}

}

eks_managed_node_group_defaults = {

cluster_version = var.mng_cluster_version

}

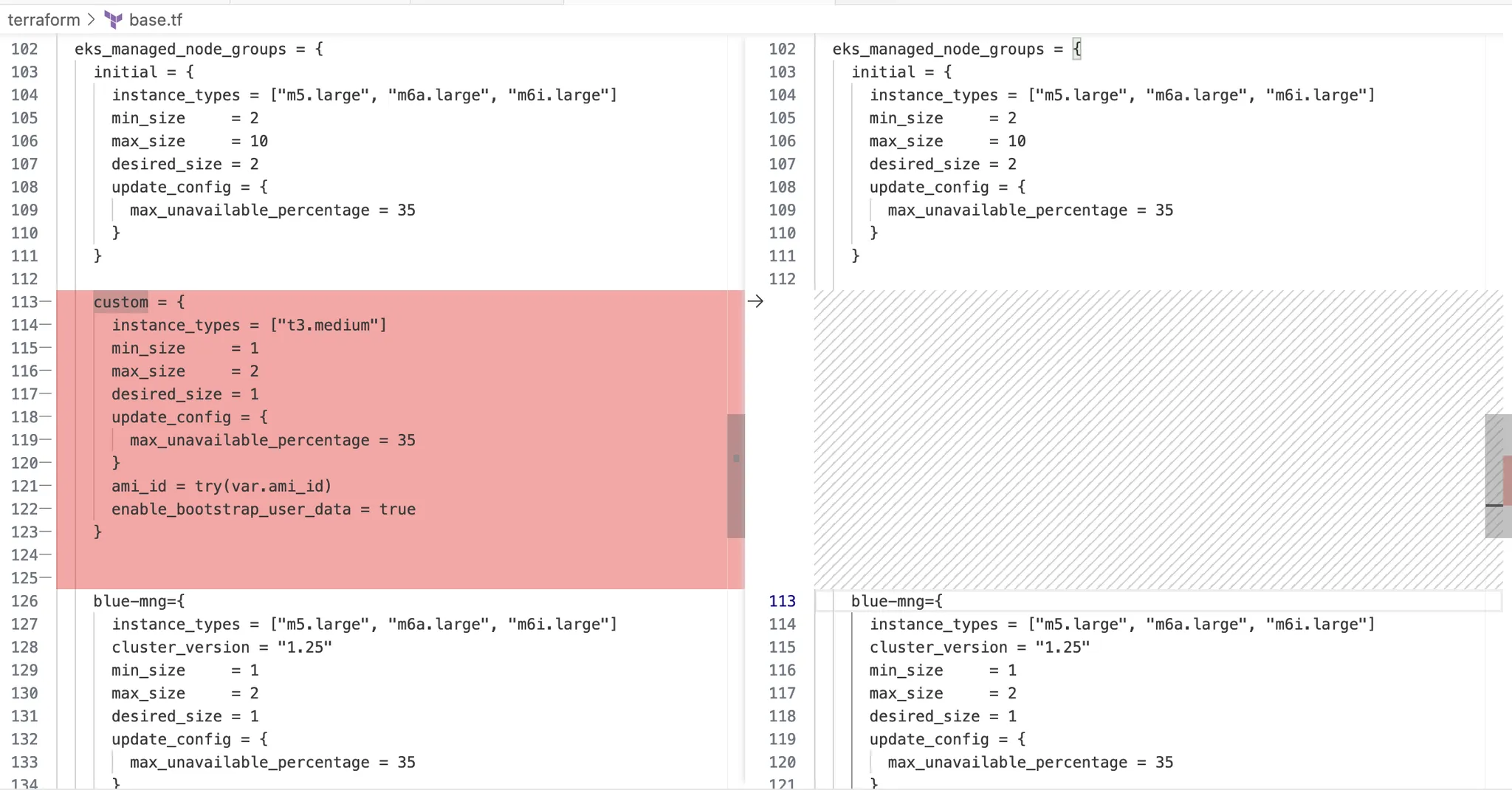

eks_managed_node_groups = {

initial = {

instance_types = ["m5.large", "m6a.large", "m6i.large"]

min_size = 2

max_size = 10

desired_size = 2

update_config = {

max_unavailable_percentage = 35

}

}

blue-mng={

instance_types = ["m5.large", "m6a.large", "m6i.large"]

cluster_version = "1.25"

min_size = 1

max_size = 2

desired_size = 1

update_config = {

max_unavailable_percentage = 35

}

labels = {

type = "OrdersMNG"

}

subnet_ids = [module.vpc.private_subnets[0]]

taints = [

{

key = "dedicated"

value = "OrdersApp"

effect = "NO_SCHEDULE"

}

]

}

}

# For demonstrating node-termination-handler

self_managed_node_groups = {

default-selfmng = {

instance_type = "m5.large"

min_size = 1

max_size = 2

desired_size = 2

# Additional configurations

ami_id = "ami-0ee947a6f4880da75" # Replace with your desired AMI ID

subnet_ids = module.vpc.private_subnets

disk_size = 100

# Optional

bootstrap_extra_args = "--kubelet-extra-args '--node-labels=node.kubernetes.io/lifecycle=self-managed,team=carts'"

# Required for self-managed node groups

create_launch_template = true

launch_template_use_name_prefix = true

}

}

tags = merge(local.tags, {

# NOTE - if creating multiple security groups with this module, only tag the

# security group that Karpenter should utilize with the following tag

# (i.e. - at most, only one security group should have this tag in your account)

"karpenter.sh/discovery" = local.name

})

}

resource "time_sleep" "wait_60_seconds" {

create_duration = "60s"

depends_on = [module.eks]

}

▶ backend_override.tf : s3 정보 추가해서 사용 할 것

terraform {

backend "s3" {}

}

▶ addons.tf

################################################################################

# EKS Blueprints Addons

################################################################################

module "eks_blueprints_addons" {

depends_on = [ time_sleep.wait_60_seconds ]

source = "aws-ia/eks-blueprints-addons/aws"

version = "~> 1.16"

cluster_name = module.eks.cluster_name

cluster_endpoint = module.eks.cluster_endpoint

cluster_version = module.eks.cluster_version

oidc_provider_arn = module.eks.oidc_provider_arn

# We want to wait for the Fargate profiles to be deployed first

create_delay_dependencies = [for prof in module.eks.fargate_profiles : prof.fargate_profile_arn]

eks_addons = {

coredns = {

addon_version = "v1.8.7-eksbuild.10"

}

kube-proxy = {

addon_version = "v1.25.16-eksbuild.8"

}

vpc-cni = {

most_recent = true

}

aws-ebs-csi-driver = {

service_account_role_arn = module.ebs_csi_driver_irsa.iam_role_arn

}

}

enable_karpenter = true

enable_aws_efs_csi_driver = true

enable_argocd = true

enable_aws_load_balancer_controller = true

enable_metrics_server = true

argocd = {

set = [

{

name = "server.service.type"

value = "LoadBalancer"

},

{

name = "server.service.annotations.service\\.beta\\.kubernetes\\.io/aws-load-balancer-scheme"

value = "internet-facing"

},

{

name = "server.service.annotations.service\\.beta\\.kubernetes\\.io/aws-load-balancer-type"

value = "external"

},

{

name = "server.service.annotations.service\\.beta\\.kubernetes\\.io/aws-load-balancer-nlb-target-type"

value = "ip"

}

]

wait = true

}

aws_load_balancer_controller = {

set = [

{

name = "vpcId"

value = module.vpc.vpc_id

},

{

name = "region"

value = local.region

},

{

name = "podDisruptionBudget.maxUnavailable"

value = 1

},

{

name = "enableServiceMutatorWebhook"

value = "false"

}

]

wait = true

}

karpenter_node = {

# Use static name so that it matches what is defined in `karpenter.yaml` example manifest

iam_role_use_name_prefix = false

}

tags = local.tags

}

resource "time_sleep" "wait_90_seconds" {

create_duration = "90s"

depends_on = [module.eks_blueprints_addons]

}

resource "aws_eks_access_entry" "karpenter_node_access_entry" {

cluster_name = module.eks.cluster_name

principal_arn = module.eks_blueprints_addons.karpenter.node_iam_role_arn

# kubernetes_groups = []

type = "EC2_LINUX"

lifecycle {

ignore_changes = [

user_name

]

}

}

################################################################################

# Supporting Resources

################################################################################

module "ebs_csi_driver_irsa" {

source = "terraform-aws-modules/iam/aws//modules/iam-role-for-service-accounts-eks"

version = "~> 5.20"

role_name_prefix = "${module.eks.cluster_name}-ebs-csi-driver-"

attach_ebs_csi_policy = true

oidc_providers = {

main = {

provider_arn = module.eks.oidc_provider_arn

namespace_service_accounts = ["kube-system:ebs-csi-controller-sa"]

}

}

tags = local.tags

}

module "efs" {

source = "terraform-aws-modules/efs/aws"

version = "~> 1.1"

creation_token = local.name

name = local.name

# Mount targets / security group

mount_targets = {

for k, v in zipmap(local.azs, module.vpc.private_subnets) : k => { subnet_id = v }

}

security_group_description = "${local.name} EFS security group"

security_group_vpc_id = module.vpc.vpc_id

security_group_rules = {

vpc = {

# relying on the defaults provided for EFS/NFS (2049/TCP + ingress)

description = "NFS ingress from VPC private subnets"

cidr_blocks = module.vpc.private_subnets_cidr_blocks

}

}

tags = local.tags

}

################################################################################

# Storage Classes

################################################################################

resource "kubernetes_annotations" "gp2" {

api_version = "storage.k8s.io/v1"

kind = "StorageClass"

# This is true because the resources was already created by the ebs-csi-driver addon

force = "true"

metadata {

name = "gp2"

}

annotations = {

# Modify annotations to remove gp2 as default storage class still retain the class

"storageclass.kubernetes.io/is-default-class" = "false"

}

depends_on = [

module.eks_blueprints_addons

]

}

resource "kubernetes_storage_class_v1" "gp3" {

metadata {

name = "gp3"

annotations = {

# Annotation to set gp3 as default storage class

"storageclass.kubernetes.io/is-default-class" = "true"

}

}

storage_provisioner = "ebs.csi.aws.com"

allow_volume_expansion = true

reclaim_policy = "Delete"

volume_binding_mode = "WaitForFirstConsumer"

parameters = {

encrypted = true

fsType = "ext4"

type = "gp3"

}

depends_on = [

module.eks_blueprints_addons

]

}

# done: update parameters

resource "kubernetes_storage_class_v1" "efs" {

metadata {

name = "efs"

}

storage_provisioner = "efs.csi.aws.com"

reclaim_policy = "Delete"

parameters = {

provisioningMode = "efs-ap"

fileSystemId = module.efs.id

directoryPerms = "755"

gidRangeStart = "100" # optional

gidRangeEnd = "200" # optional

basePath = "/dynamic_provisioning" # optional

subPathPattern = "$${.PVC.namespace}/$${.PVC.name}" # optional

ensureUniqueDirectory = "false" # optional

reuseAccessPoint = "false" # optional

}

mount_options = [

"iam"

]

depends_on = [

module.eks_blueprints_addons

]

}

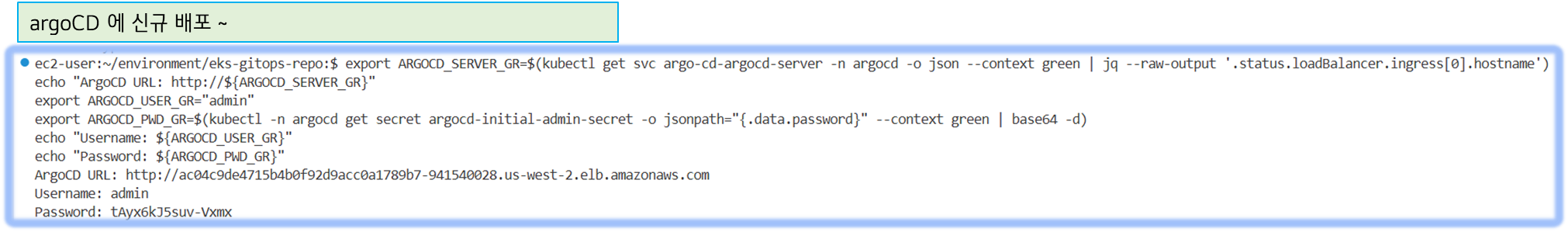

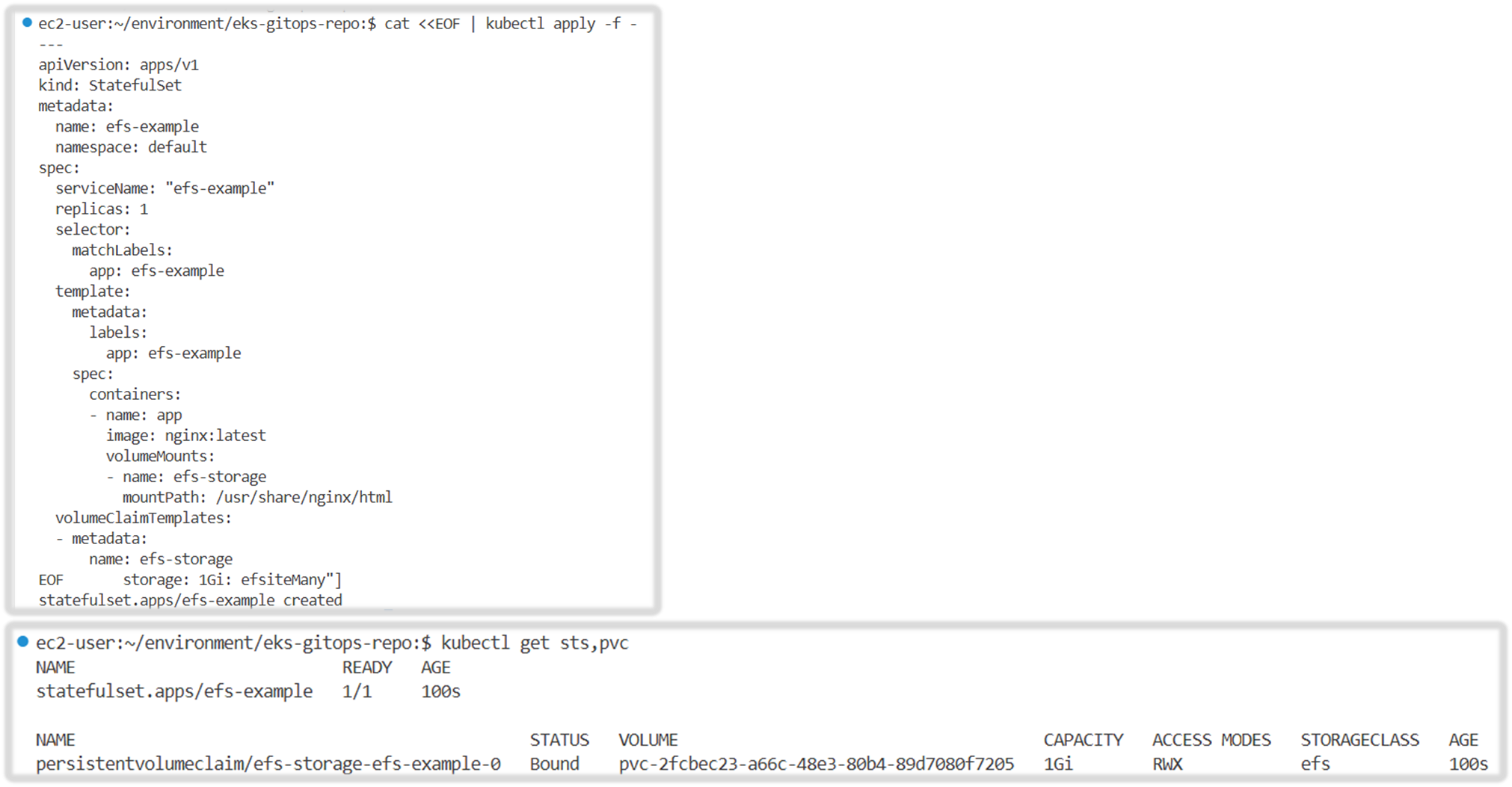

Step6. Sample application : UI Service(NLB) 설정 - ArgoCD (admin , UeVOwZPdX77bTn8C)

* argoCD 초기 비밀번호 확인방법

kubectl -n <argocd-namespace> get secret argocd-initial-admin-secret -o jsonpath="{.data.password}" | base64 --decode- 샘플 애플리케이션은 고객이 카탈로그를 탐색하고 장바구니에 항목을 추가하며 결제 프로세스를 통해 주문을 완료할 수 있는 간단한 웹 스토어 애플리케이션

- 애플리케이션에는 여러 구성 요소와 종속성이 있습니다:

|

Component

|

Description |

| UI` | Provides the front end user interface and aggregates API calls to the various other services. |

|

Catalog

|

API for product listings and details

|

|

Cart

|

API for customer shopping carts

|

|

Checkout

|

API to orchestrate the checkout process

|

|

Orders

|

API to receive and process customer orders

|

|

Static assets

|

Serves static assets like images related to the product catalog

|

- 이미지 도커파일과, ECR 공개 저장소 정보 - Link

- 처음에는 로드 밸런서나 관리형 데이터베이스와 같은 AWS 서비스를 사용하지 않고 Amazon EKS 클러스터에 자체적으로 포함된 방식으로 애플리케이션을 배포할 것입니다.

- 실험 과정에서 EKS의 다양한 기능을 활용하여 소매점의 광범위한 AWS 서비스와 기능을 활용할 것입니다.

- 모든 구성 요소는 ArgoCD를 사용하여 EKS 클러스터에 배포됩니다.

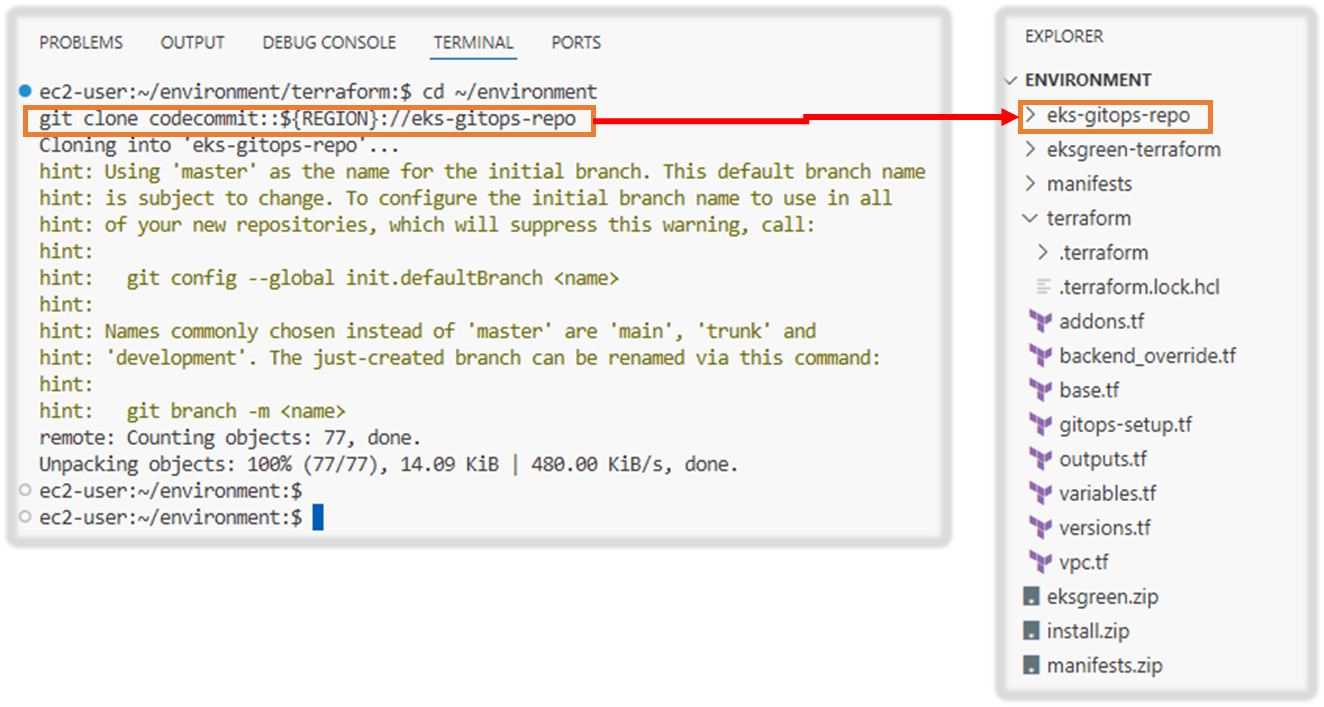

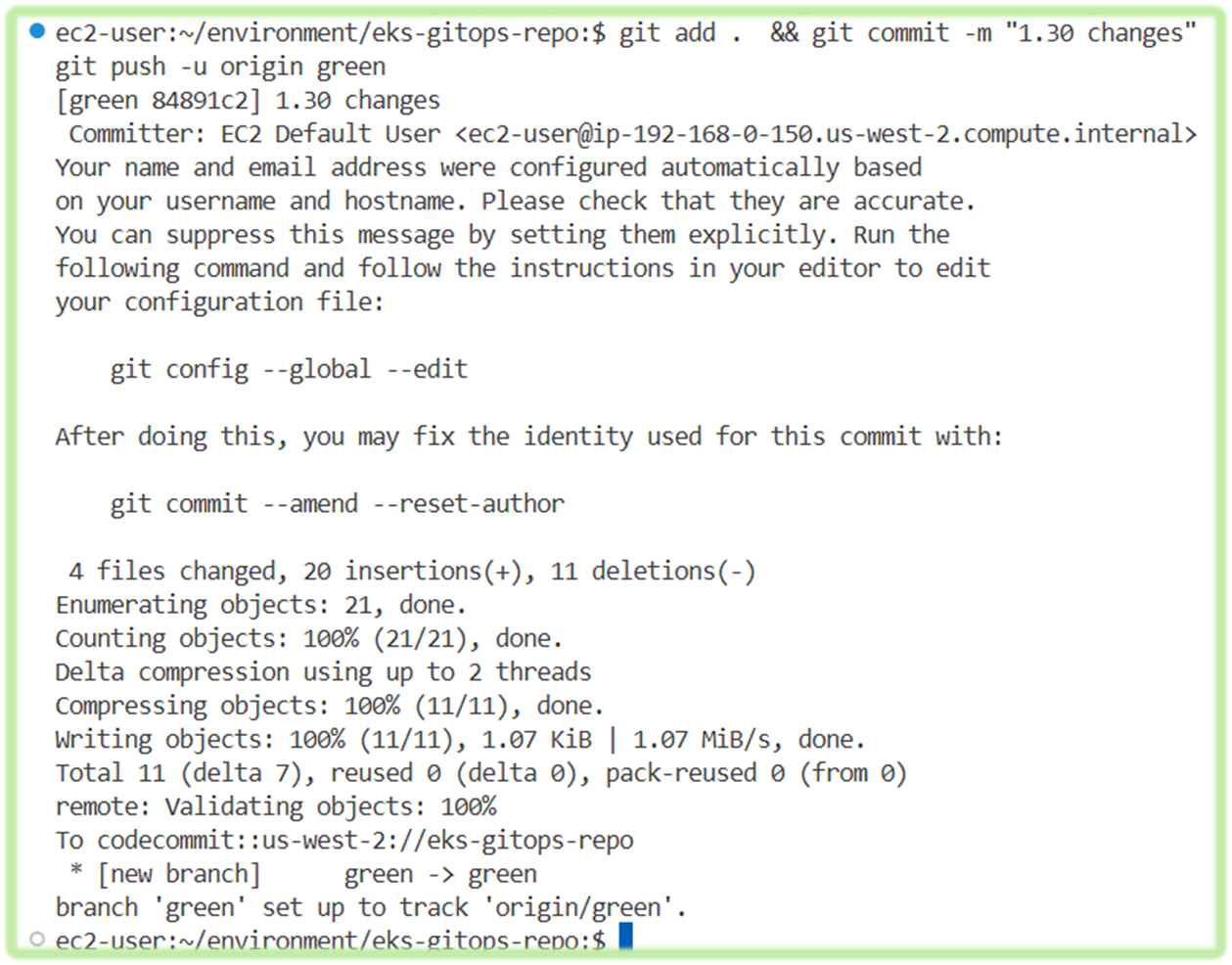

- AWS CodeCommit 저장소를 GitOps repo로 사용하여 IDE에 복제할 수 있도록 했습니다.

#

cd ~/environment

git clone codecommit::${REGION}://eks-gitops-repo

#

sudo yum install tree -y

tree eks-gitops-repo/ -L 2

eks-gitops-repo/

├── app-of-apps

│ ├── Chart.yaml

│ ├── templates

│ └── values.yaml

└── apps

├── assets

├── carts

├── catalog

├── checkout

├── karpenter

├── kustomization.yaml

├── orders

├── other

├── rabbitmq

└── ui

# Login to ArgoCD Console using credentials from following commands:

export ARGOCD_SERVER=$(kubectl get svc argo-cd-argocd-server -n argocd -o json | jq --raw-output '.status.loadBalancer.ingress[0].hostname')

echo "ArgoCD URL: http://${ARGOCD_SERVER}"

ArgoCD URL: http://k8s-argocd-argocdar-01634fea43-3cdeb4d8a7e05ff9.elb.us-west-2.amazonaws.com

export ARGOCD_USER="admin"

export ARGOCD_PWD=$(kubectl -n argocd get secret argocd-initial-admin-secret -o jsonpath="{.data.password}" | base64 -d)

echo "Username: ${ARGOCD_USER}"

echo "Password: ${ARGOCD_PWD}"

Username: admin

Password: 7kYgVfdcwv7aOo3s

혹은

export | grep ARGOCD_PWD

declare -x ARGOCD_PWD="BM4BevfR1u5GZHB3"

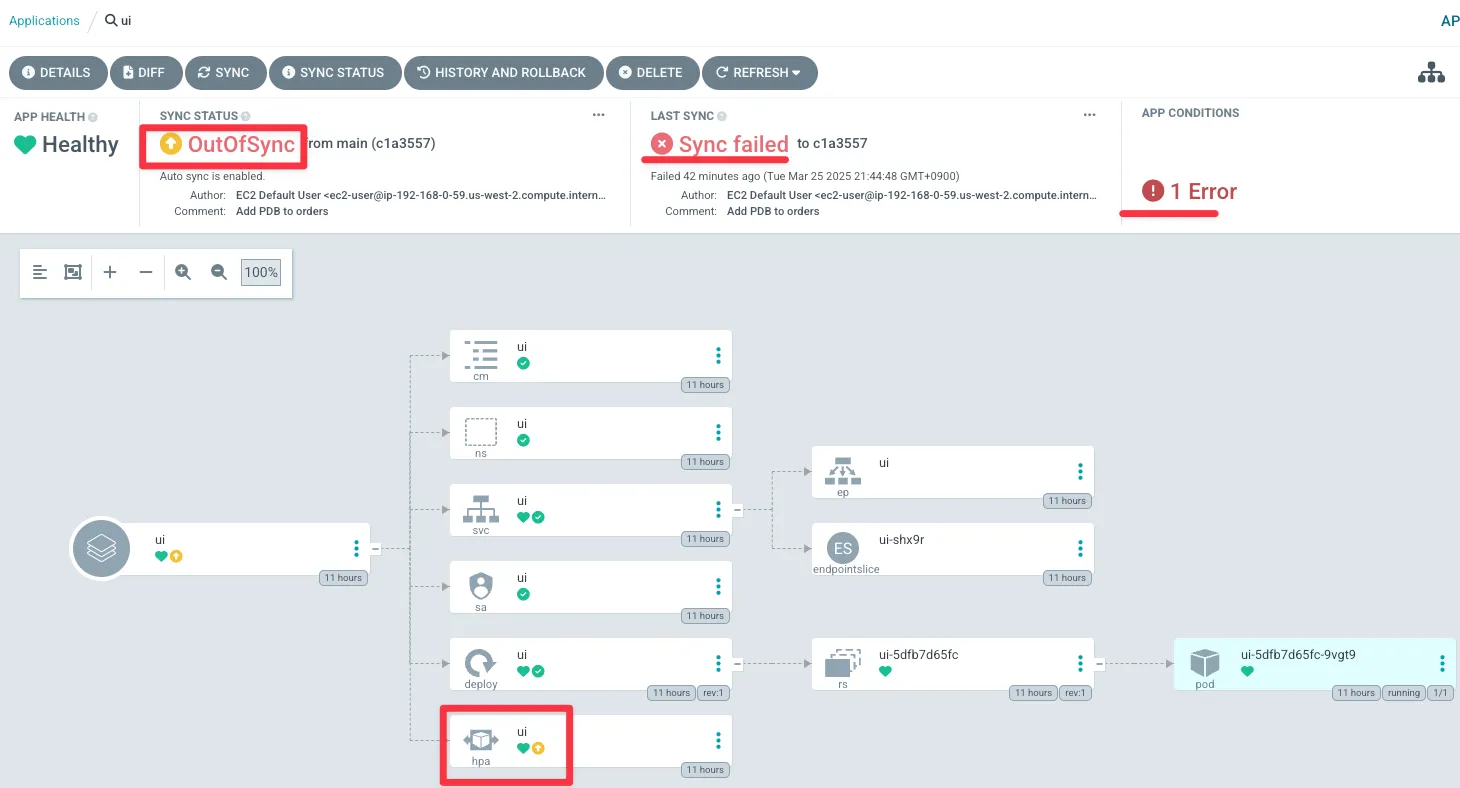

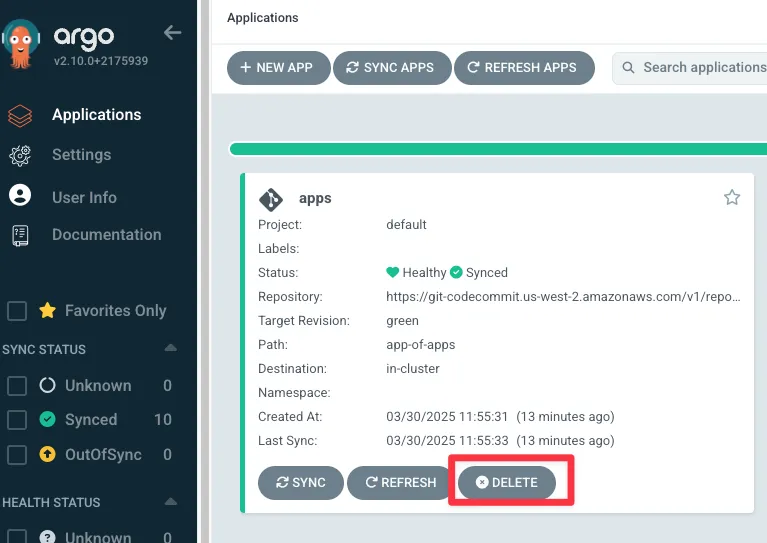

- Argo CD 웹 확인

- Argo CD CLI 확인

#

argocd login ${ARGOCD_SERVER} --username ${ARGOCD_USER} --password ${ARGOCD_PWD} --insecure --skip-test-tls --grpc-web

'admin:login' logged in successfully

Context 'k8s-argocd-argocdar-eb7166e616-ed2069d8c15177c9.elb.us-west-2.amazonaws.com' updated

#

argocd repo list

TYPE NAME REPO INSECURE OCI LFS CREDS STATUS MESSAGE PROJECT

git https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo false false false true Successful

#

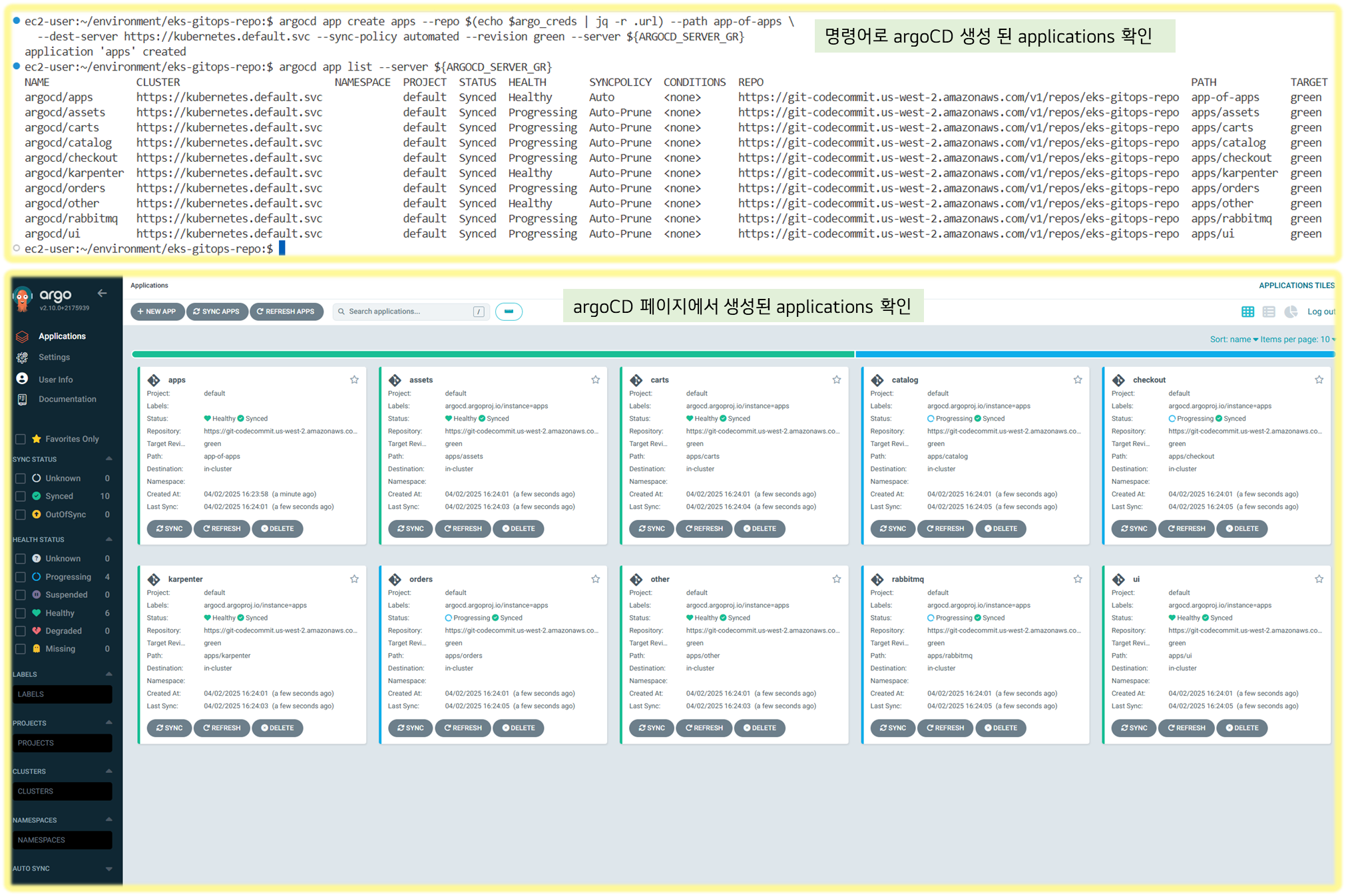

argocd app list

NAME CLUSTER NAMESPACE PROJECT STATUS HEALTH SYNCPOLICY CONDITIONS REPO PATH TARGET

argocd/apps https://kubernetes.default.svc default Synced Healthy Auto <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo app-of-apps

argocd/assets https://kubernetes.default.svc default Synced Healthy Auto-Prune <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo apps/assets main

argocd/carts https://kubernetes.default.svc default Synced Healthy Auto-Prune <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo apps/carts main

argocd/catalog https://kubernetes.default.svc default Synced Healthy Auto-Prune <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo apps/catalog main

argocd/checkout https://kubernetes.default.svc default Synced Healthy Auto-Prune <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo apps/checkout main

argocd/karpenter https://kubernetes.default.svc default Synced Healthy Auto-Prune <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo apps/karpenter main

argocd/orders https://kubernetes.default.svc default Synced Healthy Auto-Prune <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo apps/orders main

argocd/other https://kubernetes.default.svc default Synced Healthy Auto-Prune <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo apps/other main

argocd/rabbitmq https://kubernetes.default.svc default Synced Healthy Auto-Prune <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo apps/rabbitmq main

argocd/ui https://kubernetes.default.svc default OutOfSync Healthy Auto-Prune <none> https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo apps/ui main

argocd app get apps

Name: argocd/apps

Project: default

Server: https://kubernetes.default.svc

Namespace:

URL: https://k8s-argocd-argocdar-eb7166e616-ed2069d8c15177c9.elb.us-west-2.amazonaws.com/applications/apps

Source:

- Repo: https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo

Target:

Path: app-of-apps

SyncWindow: Sync Allowed

Sync Policy: Automated

Sync Status: Synced to (acc257a)

Health Status: Healthy

GROUP KIND NAMESPACE NAME STATUS HEALTH HOOK MESSAGE

argoproj.io Application argocd karpenter Synced application.argoproj.io/karpenter created

argoproj.io Application argocd carts Synced application.argoproj.io/carts created

argoproj.io Application argocd assets Synced application.argoproj.io/assets created

argoproj.io Application argocd catalog Synced application.argoproj.io/catalog created

argoproj.io Application argocd checkout Synced application.argoproj.io/checkout created

argoproj.io Application argocd rabbitmq Synced application.argoproj.io/rabbitmq created

argoproj.io Application argocd other Synced application.argoproj.io/other created

argoproj.io Application argocd ui Synced application.argoproj.io/ui created

argoproj.io Application argocd orders Synced application.argoproj.io/orders created

argocd app get carts

Name: argocd/carts

Project: default

Server: https://kubernetes.default.svc

Namespace:

URL: https://k8s-argocd-argocdar-eb7166e616-ed2069d8c15177c9.elb.us-west-2.amazonaws.com/applications/carts

Source:

- Repo: https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo

Target: main

Path: apps/carts

SyncWindow: Sync Allowed

Sync Policy: Automated (Prune)

Sync Status: Synced to main (acc257a)

Health Status: Healthy

GROUP KIND NAMESPACE NAME STATUS HEALTH HOOK MESSAGE

Namespace carts Synced namespace/carts created

ServiceAccount carts carts Synced serviceaccount/carts created

ConfigMap carts carts Synced configmap/carts created

Service carts carts-dynamodb Synced Healthy service/carts-dynamodb created

Service carts carts Synced Healthy service/carts created

apps Deployment carts carts Synced Healthy deployment.apps/carts created

apps Deployment carts carts-dynamodb Synced Healthy deployment.apps/carts-dynamodb created

#

argocd app get carts -o yaml

...

spec:

destination:

server: https://kubernetes.default.svc

ignoreDifferences:

- group: apps

jsonPointers:

- /spec/replicas

- /metadata/annotations/deployment.kubernetes.io/revision

kind: Deployment

- group: autoscaling

jsonPointers:

- /status

kind: HorizontalPodAutoscaler

project: default

source:

path: apps/carts

repoURL: https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo

targetRevision: main

syncPolicy:

automated:

prune: true

selfHeal: true

syncOptions:

- RespectIgnoreDifferences=true

...

argocd app get ui -o yaml

...

spec:

destination:

server: https://kubernetes.default.svc

ignoreDifferences:

- group: apps

jsonPointers:

- /spec/replicas

- /metadata/annotations/deployment.kubernetes.io/revision

kind: Deployment

- group: autoscaling

jsonPointers:

- /status

kind: HorizontalPodAutoscaler

project: default

source:

path: apps/ui

repoURL: https://git-codecommit.us-west-2.amazonaws.com/v1/repos/eks-gitops-repo

targetRevision: main

syncPolicy:

automated:

prune: true

selfHeal: true

syncOptions:

- RespectIgnoreDifferences=true

...

▶ (추가) UI 접속을 위한 NLB 설정

#

cat << EOF > ~/environment/eks-gitops-repo/apps/ui/service-nlb.yaml

apiVersion: v1

kind: Service

metadata:

annotations:

service.beta.kubernetes.io/aws-load-balancer-nlb-target-type: ip

service.beta.kubernetes.io/aws-load-balancer-scheme: internet-facing

service.beta.kubernetes.io/aws-load-balancer-type: external

labels:

app.kubernetes.io/instance: ui

app.kubernetes.io/name: ui

name: ui-nlb

namespace: ui

spec:

type: LoadBalancer

ports:

- name: http

port: 80

protocol: TCP

targetPort: 8080

selector:

app.kubernetes.io/instance: ui

app.kubernetes.io/name: ui

EOF

cat << EOF > ~/environment/eks-gitops-repo/apps/ui/kustomization.yaml

apiVersion: kustomize.config.k8s.io/v1beta1

kind: Kustomization

namespace: ui

resources:

- namespace.yaml

- configMap.yaml

- serviceAccount.yaml

- service.yaml

- deployment.yaml

- hpa.yaml

- service-nlb.yaml

EOF

#

cd ~/environment/eks-gitops-repo/

git add apps/ui/service-nlb.yaml apps/ui/kustomization.yaml

git commit -m "Add to ui nlb"

git push

argocd app sync ui

...

#

# UI 접속 URL 확인 (1.5, 1.3 배율)

kubectl get svc -n ui ui-nlb -o jsonpath='{.status.loadBalancer.ingress[0].hostname}' | awk '{ print "UI URL = http://"$1""}'

▶ [옵션] AWS CLI 자격증명 확인 - 제공된 IDE 환경에서만 정상적인 자격증명 동작함!!

# IDE-Server

aws sts get-caller-identity

{

"UserId": "AROAVJNSDOMR55BSJL27Y:i-00d9a1ac022bd4f29",

"Account": "363835126563",

"Arn": "arn:aws:sts::363835126563:assumed-role/workshop-stack-IdeIdeRoleD654ADD4-nSApoLMDr5GW/i-00d9a1ac022bd4f29"

}

aws s3 ls

2025-03-28 11:56:25 workshop-stack-tfstatebackendbucketf0fc9a9d-2phddn8usnlw

# 자신의 PC에서 aws cli 자격증명 사용 시

aws sts get-caller-identity

{

"UserId": "AROAVJNSDOMR7XPF3SIBJ:Participant",

"Account": "363835126563",

"Arn": "arn:aws:sts::363835126563:assumed-role/WSParticipantRole/Participant"

}

aws s3 ls

An error occurred (AccessDenied) when calling the ListBuckets operation: User: arn:aws:sts::363835126563:assumed-role/WSParticipantRole/Participant is not authorized to perform: s3:ListAllMyBuckets because no identity-based policy allows the s3:ListAllMyBuckets action

eksctl get cluster

NAME REGION EKSCTL CREATED

eksworkshop-eksctl us-west-2 False3-2. Introduction

▶ K8S(+AWS EKS) Release Cycles

쿠버네티스 프로젝트는 새로운 기능, 최신 보안 패치 및 버그 수정으로 지속적으로 업데이트됩니다. 쿠버네티스 버전 의미론을 처음 접하는 경우 의미론적 버전 관리를 따릅니다. 용어이며 일반적으로 xyz 로 표현되며 , 여기서 x 는 주요 버전이고, y 는 부차 버전이고, z는 패치 버전입니다. 새로운 Kubernetes 부차 버전( y )은 대략 4개월마다 출시되며, 모든 버전 >=v1.19에는 12개월 동안 표준 지원이 제공됩니다. 한 번에 최소 3개의 부차 버전에 대한 표준 지원이 제공됩니다. Kubernetes 프로젝트는 가장 최근의 3개 부차 릴리스에 대한 릴리스 브랜치를 유지 관리하며, 최신 Kubernetes 릴리스와 관련된 자세한 내용은 여기에서 확인할 수 있습니다. .

Amazon EKS 출시 일정 및 지원

Amazon Elastic Kubernetes Service(EKS)는 Kubernetes 프로젝트 릴리스 주기를 따르지만, 한 번에 4개의 마이너 버전에 대한 표준 지원을 제공하며, Amazon EKS에서 버전이 처음 제공된 후 14개월 동안 지속됩니다. 이는 업스트림 Kubernetes가 Amazon EKS에서 제공되는 버전을 더 이상 지원하지 않는 경우에도 마찬가지입니다. Amazon EKS에서 지원되는 Kubernetes 버전에 적용되는 보안 패치를 백포트합니다.

Amazon EKS Kubernetes 출시 일정 Amazon EKS에서 지원되는 각 Kubernetes 버전에 대한 중요한 릴리스 및 지원 날짜가 있습니다. 최신 EKS 버전의 릴리스가 Kubernetes의 해당 버전보다 몇 주 정도 뒤처지는 이유가 궁금하다면, Amazon이 Kubernetes의 새 버전이 Amazon EKS에서 제공되기 전에 다른 AWS 서비스 및 도구와의 안정성과 호환성을 철저히 테스트하기 때문입니다. 새 버전이 얼마나 빨리 지원될지에 대한 구체적인 날짜나 SLA는 제공하지 않지만, Amazon EKS 팀은 업스트림 릴리스와 EKS에 제공되는 지원 간의 격차를 메우기 위해 노력하고 있습니다.

Amazon EKS는 표준 지원 외에도 최근 확장 지원 기능을 출시했습니다( 출시 발표) ). 모든 Kubernetes 버전 1.21 이상은 이제 Amazon EKS에서 확장 지원을 받을 수 있습니다. 확장 지원은 표준 지원이 종료된 직후 자동으로 시작되어 12개월 더 지속되어 각 Kubernetes 마이너 버전에 대한 지원이 총 26개월로 늘어납니다. 클러스터가 확장 지원 기간이 끝나기 전에 업데이트되지 않으면 현재 지원되는 가장 오래된 확장 버전으로 자동 업그레이드됩니다. 자세한 내용은 Kubernetes 버전에 대한 Amazon EKS 확장 지원을 참조하세요.

확장 지원 기간 동안 Kubernetes 버전을 실행하는 클러스터의 가격은 2024년 4월 1일부터 클러스터당 시간당 총 $0.60으로 청구되는 반면, 표준 지원 비용(클러스터당 시간당 $0.10)은 변경되지 않습니다.

2024년 7월 23일 Amazon EKS는 Kubernetes 버전 정책( 출시 발표) 을 발표했습니다. ). Kubernetes 버전 정책에 대한 Amazon EKS 제어를 통해 클러스터 관리자는 EKS 클러스터에 대한 표준 지원 종료 동작을 선택할 수 있습니다. 이러한 제어를 통해 Kubernetes 버전에 대한 표준 지원 종료 시 확장 지원에 들어갈 클러스터와 자동으로 업그레이드될 클러스터를 결정할 수 있습니다. 이 제어는 클러스터당 실행되는 환경 또는 애플리케이션에 따라 버전 업그레이드와 비즈니스 요구 사항 간의 균형을 맞출 수 있는 유연성을 제공합니다.

속성을 사용하여 새 클러스터와 기존 클러스터 모두에 대한 버전 정책을 설정할 수 있습니다 supportType. 버전 지원 정책을 설정하는 데 사용할 수 있는 두 가지 옵션이 있습니다.

STANDARD— 표준 지원 종료 시 자동 업그레이드가 가능한 EKS 클러스터. 이 설정에서는 확장 지원 요금이 발생하지 않지만 EKS 클러스터는 표준 지원에서 지원되는 다음 Kubernetes 버전으로 자동 업그레이드됩니다.

EXTENDED— Kubernetes 버전이 표준 지원 종료에 도달하면 EKS 클러스터가 확장 지원으로 전환됩니다. 이 설정으로 확장 지원 요금이 부과됩니다. 클러스터를 표준 지원 Kubernetes 버전으로 업그레이드하면 확장 지원 요금이 부과되지 않습니다. 확장 지원으로 실행되는 클러스터는 확장 지원 종료 시 자동 업그레이드 대상이 됩니다.

이 동작은 EKS 콘솔 및 CLI를 통해 쉽게 설정할 수 있습니다. 자세한 내용은 클러스터 업그레이드 정책을 참조하세요.

▶ 왜 업그레이드를 해야 하나요?

컨테이너 관리 플랫폼으로 Kubernetes 또는 Amazon Elastic Kubernetes Service(EKS)를 선택할 때 고려해야 할 핵심 사항 중 하나는 정기적인 클러스터 업그레이드를 계획하고 커밋하는 것입니다. Amazon EKS 버전을 업데이트하는 것은 Kubernetes 클러스터의 보안, 안정성, 성능 및 호환성을 유지하는 데 중요하며, 플랫폼에서 제공하는 최신 기능과 역량을 활용할 수 있도록 보장합니다.

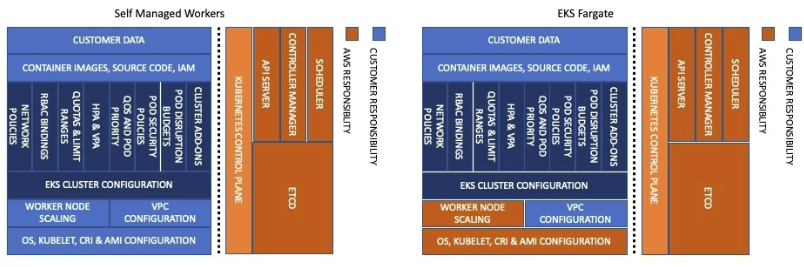

[ 공동 책임 모델 ]

- 참고 : https://catalog.us-east-1.prod.workshops.aws/event/dashboard/en-US/workshop/introduction/why-upgrade

Kubernetes 버전은 제어 평면과 데이터 평면을 모두 포함합니다. AWS가 제어 평면을 관리하고 업그레이드하는 동안, 귀하(클러스터 소유자/고객)는 클러스터 제어 평면과 데이터 평면 모두에 대한 업그레이드를 시작할 책임이 있습니다. 클러스터 업그레이드를 시작하면 AWS가 제어 평면을 업그레이드하고 귀하는 여전히 데이터 평면의 업그레이드를 시작할 책임이 있습니다. 여기에는 Self Managed 노드 그룹, Managed 노드 그룹, Fargate 및 기타 애드온을 통해 프로비저닝된 작업자 노드가 포함됩니다. . 작업자 노드가 Karpenter Controller를 통해 프로비저닝되는 경우 Drift 를 활용할 수 있습니다. 또는 Disruption Controller 자동 노드 재활용 및 업그레이드를 위한 기능( spec.expireAfter). 클러스터 업그레이드를 계획할 때 워크로드의 애플리케이션 가용성을 보장하고 적절한 PodDisruptionBudgets를 확보해야 합니다. 그리고 토폴로지 스프레드 제약 조건 데이터 플레인이 업그레이드되는 동안 워크로드의 가용성을 보장하는 것이 중요합니다.

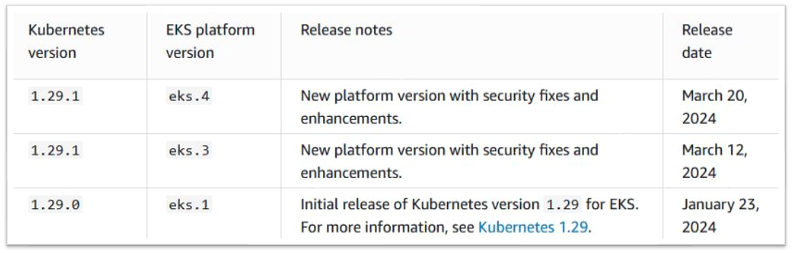

Amazon EKS는 Kubernetes 부 버전 외에도 새로운 Kubernetes 제어 평면 설정을 활성화하고 보안 수정 사항을 제공하기 위해 주기적으로 새로운 플랫폼 버전을 출시합니다. 각 Amazon EKS 부 버전은 하나 이상의 연관된 플랫폼 버전을 가질 수 있습니다. Amazon EKS에서 1.30과 같은 새로운 Kubernetes 부 버전이 제공되는 경우 해당 Kubernetes 부 버전의 초기 플랫폼 버전은 eks.1에서 시작하고 새로운 릴리스가 있을 때마다 플랫폼 버전이 증가합니다( ). 아래 표는 이를 더 잘 시각화하는 데 도움이 되며 Amazon EKS 플랫폼 버전eks.n+1 에서 자세한 내용을 찾을 수 있습니다. 좋은 소식은 Amazon EKS가 모든 기존 클러스터를 해당 Kubernetes 마이너 버전에 맞는 최신 Amazon EKS 플랫폼 버전으로 자동 업그레이드하므로 사용자 측에서 명시적으로 조치를 취할 필요가 없다는 것입니다.

따라서 Kubernetes 업데이트 관점에서 최신 마이너 버전 을 유지하는 것은 안전하고 효율적인 EKS 환경에 가장 중요하며, 이는 Amazon EKS의 공유 책임 모델을 반영합니다. 클러스터가 최신 보안 패치와 버그 수정을 실행하고 있는지 확인하여 보안 취약성의 위험을 줄입니다. 또한 향상된 성능, 확장성 및 안정성을 제공하여 애플리케이션과 고객에게 더 나은 서비스를 제공합니다.

▶ Amazon EKS 업그레이드

이 워크숍을 진행하면서 인플레이스 클러스터 업그레이드 및 블루그린 업그레이드와 같은 다양한 업그레이드 전략에 대해 알아봅니다. 또한 업그레이드 전략을 결정하는 기준과 이러한 각 전략을 수행하는 방법에 대한 자세한 단계에 대해서도 알아봅니다.

아래는 기존 클러스터 업그레이드의 높은 수준의 워크플로우입니다. 다음 모듈에서 이에 대해 더 자세히 살펴보겠습니다.

Amazon EKS 클러스터의 기존 업그레이드를 수행하려면 아래 작업을 수행해야 합니다.

- Kubernetes 및 EKS 릴리스 노트를 검토하세요. . 또한 업그레이드하기 전에 확인하세요 업그레이드를 시작하기 전에 구현해야 할 중요한 정책, 도구 및 절차를 검토하는 섹션입니다.

- 클러스터 백업을 수행합니다. (선택 사항)

- AWS 콘솔이나 CLI를 사용하여 클러스터 제어 평면을 업그레이드합니다.

- 추가 기능 호환성을 검토하세요.

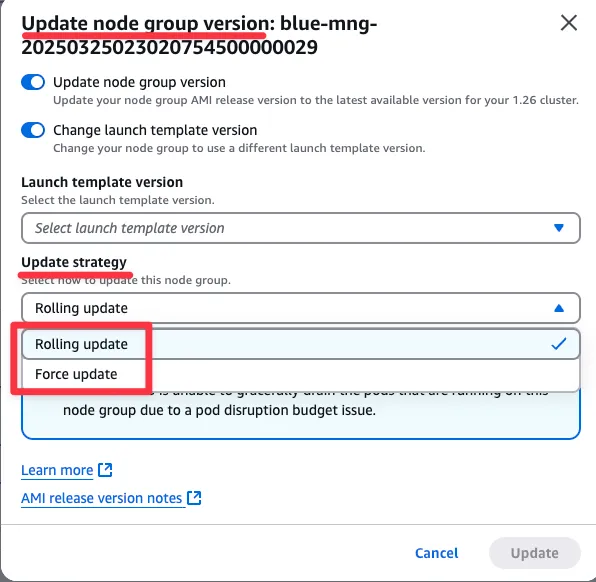

- 클러스터 데이터 플레인을 업그레이드합니다.

위의 단계는 높은 수준의 시퀀스만을 나타내며, API 지원 중단/해결, 버전 불균형 검사 등 다른 검사가 있을 수 있습니다. 자세한 내용은 여기에서 확인할 수 있습니다. 또한 클러스터 업그레이드를 참조하세요. Amazon EKS 클러스터 업그레이드와 관련된 모범 사례 및 지침은 EKS 모범 사례 가이드 섹션을 참조하세요.

이제 다음 섹션에서 EKS 클러스터 업그레이드를 준비하는 과정을 시작해 보겠습니다.

3-3. Preparing for Cluster Upgrades

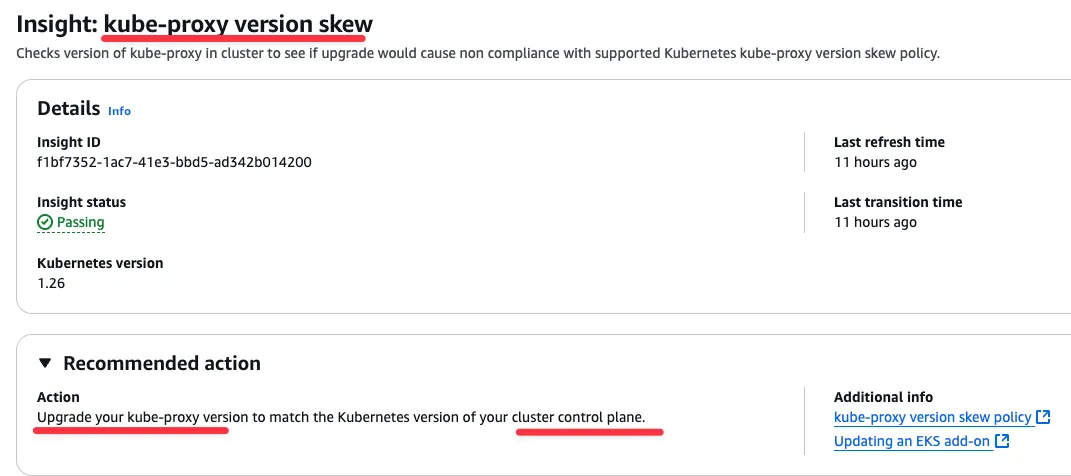

▶ EKS 업그레이드 인사이트

EKS 업그레이드 인사이트

aws eks list-insights --filter kubernetesVersions=1.26 --cluster-name $CLUSTER_NAME | jq .Amazon EKS 클러스터 인사이트는 Amazon EKS 및 Kubernetes 모범 사례를 따르는 데 도움이 되는 권장 사항을 제공합니다. 모든 Amazon EKS 클러스터는 Amazon EKS에서 큐레이팅한 인사이트 목록에 대해 자동으로 반복되는 검사를 거칩니다. 이러한 인사이트 검사는 Amazon EKS에서 완전히 관리하며 발견 사항을 해결하는 방법에 대한 권장 사항을 제공합니다. Cluster Insights를 활용하면 최신 Kubernetes 버전으로 업그레이드하는 데 드는 노력을 최소화할 수 있습니다.

Amazon EKS 업그레이드 인사이트로 Kubernetes 업그레이드 간소화

Amazon EKS가 제어 평면 업그레이드를 자동화하는 반면, 업그레이드로 인해 영향을 받을 가능성이 있는 리소스나 애플리케이션을 식별하는 것은 수동 프로세스였습니다. 여기에는 릴리스 노트를 검토하여 더 이상 사용되지 않거나 제거된 Kubernetes API를 확인한 다음 해당 API를 사용하는 애플리케이션을 검색하여 수정하는 작업이 포함됩니다.

구조에 대한 통찰력을 업그레이드하세요

Amazon EKS 업그레이드 인사이트는 이러한 과제를 해결합니다. 매일 클러스터 감사 로그를 스캔하여 사용되지 않는 리소스를 찾고 EKS 콘솔에 결과를 표시하거나 API 또는 CLI를 통해 프로그래밍 방식으로 검색할 수 있습니다.

현재 Amazon EKS는 Kubernetes 버전 업그레이드 준비와 관련된 통찰력만 반환합니다.

참고: 클러스터 인사이트는 주기적으로 업데이트됩니다. 클러스터 인사이트를 수동으로 새로 고칠 수 없습니다. 클러스터 문제를 해결하면 클러스터 인사이트가 업데이트되는 데 시간이 걸립니다.

각 통찰력에는 다음이 포함됩니다.

- 권장 사항: 문제를 해결하기 위한 단계.

- 링크: 릴리스 노트, 블로그 게시물과 같은 추가 정보입니다.

- 리소스 목록: 심각도를 반영하는 상태(통과, 경고, 오류, 알 수 없음)가 있는 Kubernetes 리소스 유형(예: CronJobs)입니다.

- 오류: 다음 마이너 버전에서 API에 대한 호출이 제거되었습니다. 업그레이드 후 업그레이드가 실패합니다.

- 경고: 임박한 문제이지만 즉각적인 조치가 필요하지 않습니다(2개 이상 릴리스된 버전에서 지원 중단).

- 알 수 없음: 백엔드 처리 오류.

- 전체 상태: 인사이트의 모든 리소스 중에서 가장 높은 심각도 상태입니다. 이를 통해 업그레이드하기 전에 클러스터에 수정이 필요한지 빠르게 확인할 수 있습니다.

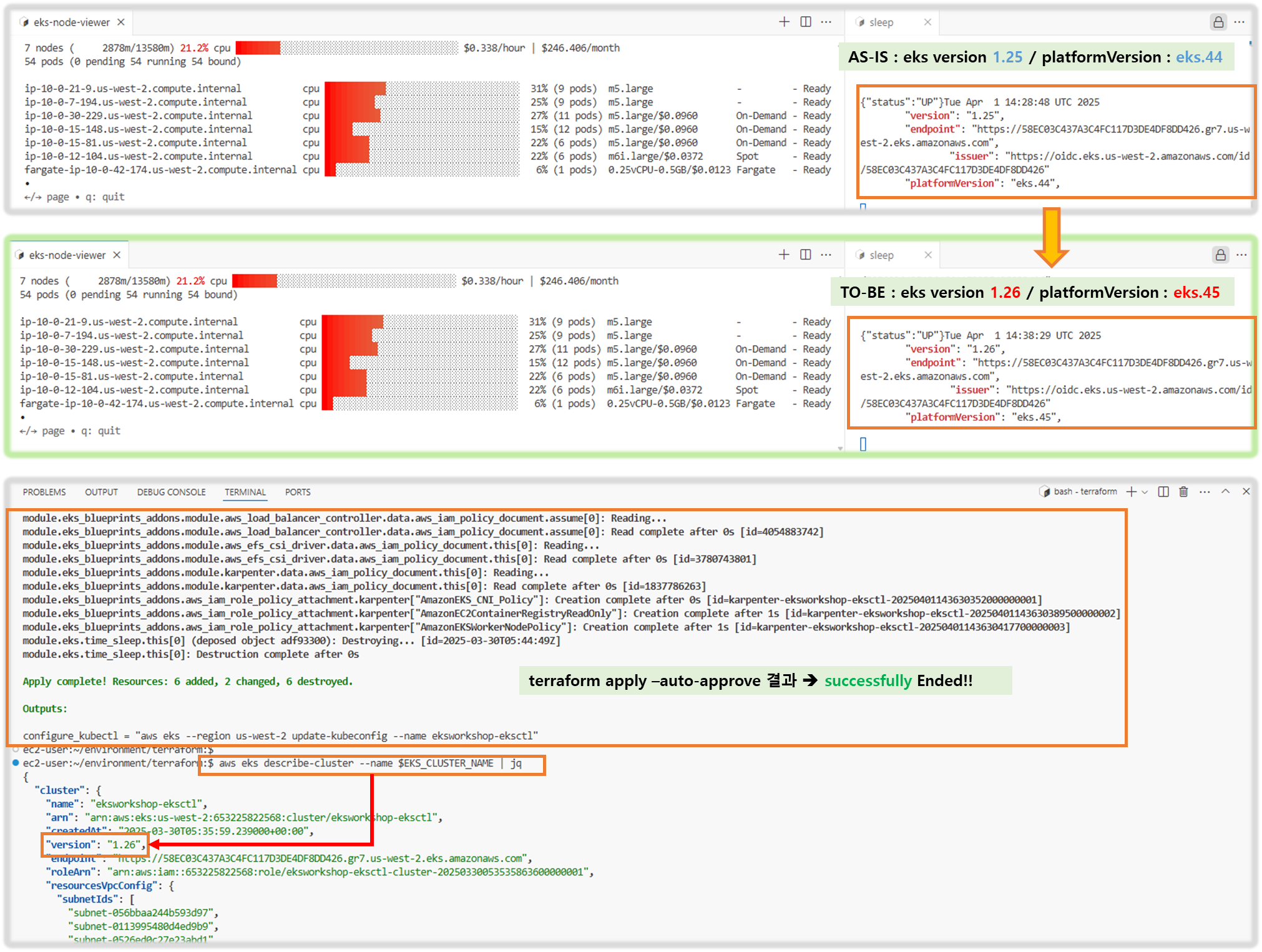

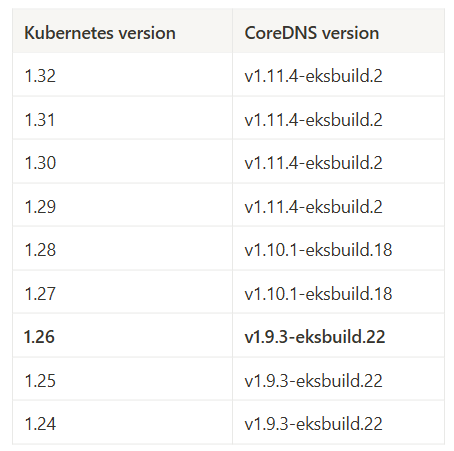

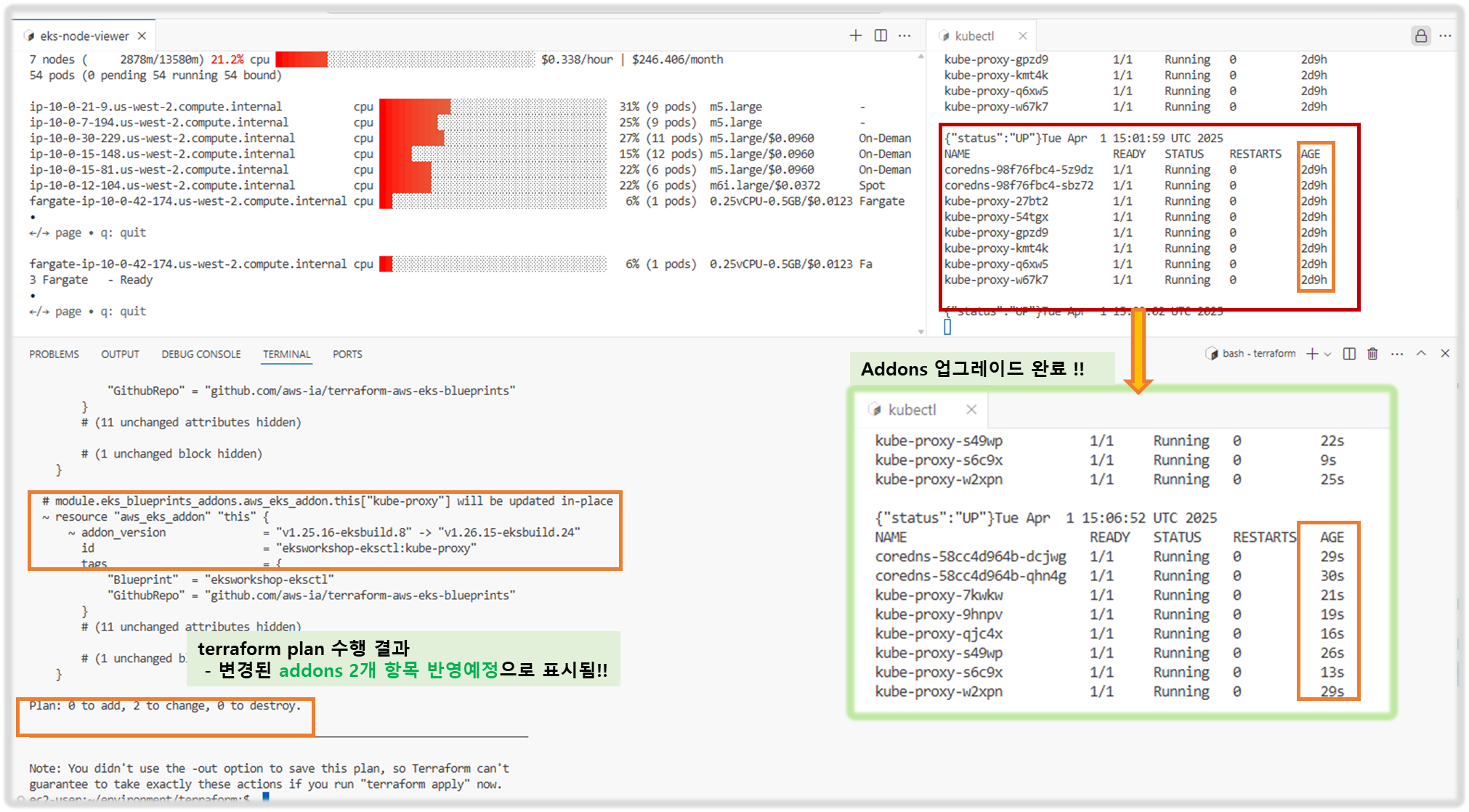

Amazon EKS 클러스터를 버전 1.25에서 1.26으로 업그레이드하는 방법을 알아보겠습니다. 대상 버전인 1.26과 관련된 클러스터 인사이트를 가져오는 것으로 시작하겠습니다.

EKS 클러스터의 통찰력을 보려면 다음 명령을 실행할 수 있습니다.

aws eks list-insights --filter kubernetesVersions=1.26 --cluster-name $CLUSTER_NAME | jq .Output :

{

"insights": [

{

"id": "4c7c2fc1-253d-463f-b2c4-2d302ccc4a10",

"name": "Deprecated APIs removed in Kubernetes v1.26",

"category": "UPGRADE_READINESS",

"kubernetesVersion": "1.26",

"lastRefreshTime": "2024-05-16T10:07:51+00:00",

"lastTransitionTime": "2024-05-13T21:52:45+00:00",

"description": "Checks for usage of deprecated APIs that are scheduled for removal in Kubernetes v1.26. Upgrading your cluster before migrating to the updated APIs supported by v1.26 could cause application impact.",

"insightStatus": {

"status": "PASSING",

"reason": "No deprecated API usage detected within the last 30 days."

}

}

]

}수신된 통찰력에 대한 보다 자세한 설명적 출력을 위해 다음과 같이 --id 플래그를 특정 통찰력 ID로 바꿔서 describe-insight 명령을 실행할 수 있습니다.

{

"insight": {

"id": "4c7c2fc1-253d-463f-b2c4-2d302ccc4a10",

"name": "Deprecated APIs removed in Kubernetes v1.26",

"category": "UPGRADE_READINESS",

"kubernetesVersion": "1.26",

"lastRefreshTime": "2024-05-16T10:07:51+00:00",

"lastTransitionTime": "2024-05-13T21:52:45+00:00",

"description": "Checks for usage of deprecated APIs that are scheduled for removal in Kubernetes v1.26. Upgrading your cluster before migrating to the updated APIs supported by v1.26 could cause application impact.",

"insightStatus": {

"status": "PASSING",

"reason": "No deprecated API usage detected within the last 30 days."

},

"recommendation": "Update manifests and API clients to use newer Kubernetes APIs if applicable before upgrading to Kubernetes v1.26.",

"additionalInfo": {

"EKS update cluster documentation": "https://docs.aws.amazon.com/eks/latest/userguide/update-cluster.html",

"Kubernetes v1.26 deprecation guide": "https://kubernetes.io/docs/reference/using-api/deprecation-guide/#v1-26"

},

"resources": [],

"categorySpecificSummary": {

"deprecationDetails": [

{

"usage": "/apis/flowcontrol.apiserver.k8s.io/v1beta1/flowschemas",

"replacedWith": "/apis/flowcontrol.apiserver.k8s.io/v1beta3/flowschemas",

"stopServingVersion": "1.26",

"startServingReplacementVersion": "1.26",

"clientStats": []

},

{

"usage": "/apis/flowcontrol.apiserver.k8s.io/v1beta1/prioritylevelconfigurations",

"replacedWith": "/apis/flowcontrol.apiserver.k8s.io/v1beta3/prioritylevelconfigurations",

"stopServingVersion": "1.26",

"startServingReplacementVersion": "1.26",

"clientStats": []

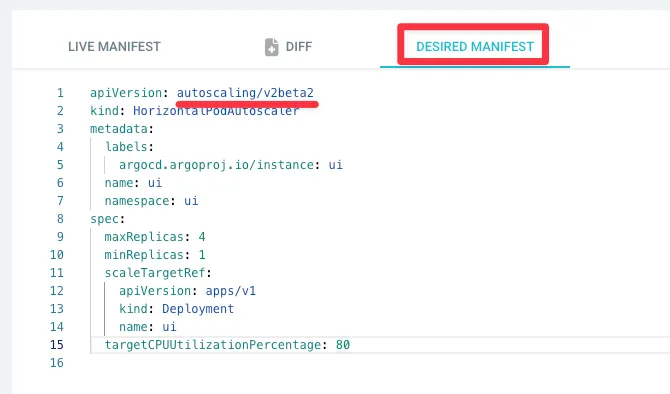

},

{

"usage": "/apis/autoscaling/v2beta2/horizontalpodautoscalers",

"replacedWith": "/apis/autoscaling/v2/horizontalpodautoscalers",

"stopServingVersion": "1.26",

"startServingReplacementVersion": "1.23",

"clientStats": []

}

]

}

}

}

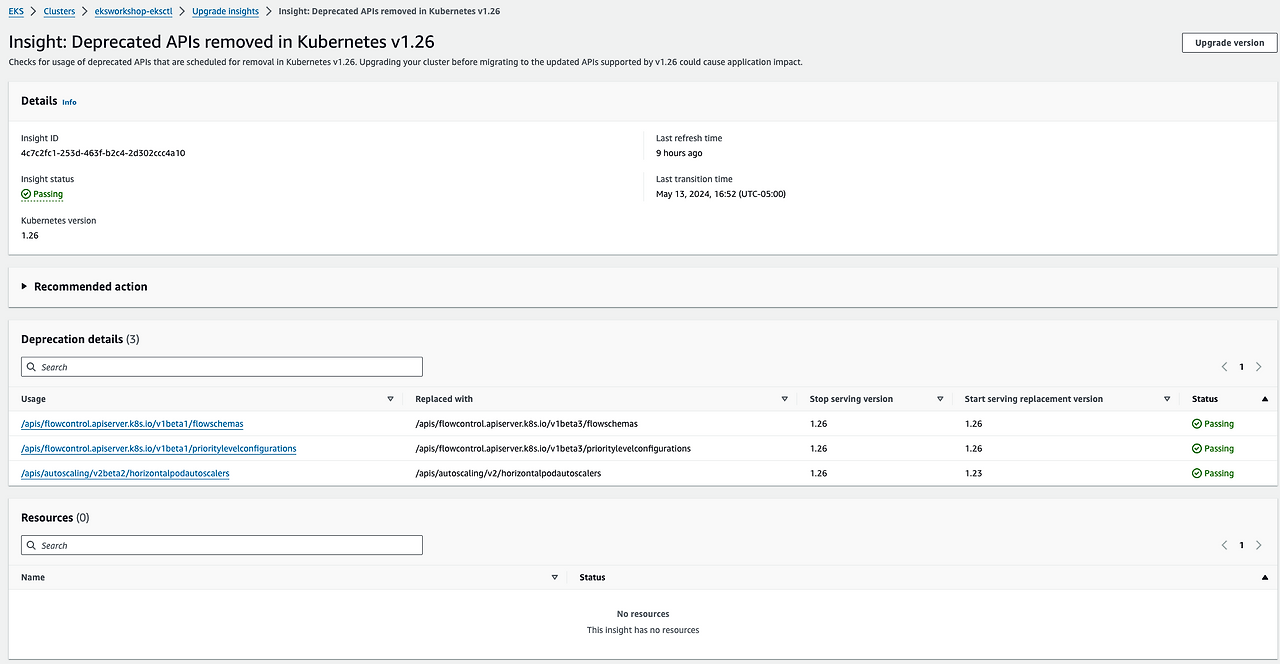

이 정보는 Amazon EKS 콘솔 업그레이드 인사이트 탭에서도 얻을 수 있습니다. EKS AWS 콘솔에서 업그레이드 인사이트로 이동하는 방법은 다음과 같습니다.

- Amazon EKS 콘솔을 엽니다: https://console.aws.amazon.com/eks/home

- 클러스터 목록에서 통찰력을 보고 싶은 특정 Amazon EKS 클러스터의 이름을 선택합니다.

- 업그레이드 인사이트 탭을 클릭하세요.

업그레이드 인사이트 페이지에는 클러스터 환경에서 감지된 잠재적인 업그레이드 준비 문제에 대한 정보가 표시됩니다. 이 정보는 EKS에서 지원하는 향후 Kubernetes 버전으로의 업그레이드를 계획하고 실행하는 데 유용합니다.

참고: 현재 v1.25에서 v1.26으로 업그레이드하는 시나리오에서는 ERROR 또는 WARNING 메시지가 나타나지 않습니다. 그러나 이는 클러스터마다 다를 수 있습니다.

설명 시나리오:

다음은 업그레이드 인사이트 탭에서 API 상태가 ERROR로 표시되는 예이며, 이는 해당 API가 v1.25에서 지원 중단될 예정임을 나타냅니다.

이 API 지원 중단에 대한 자세한 정보를 보려면 인사이트 이름을 클릭하세요.

이 이미지에서 우리는 업그레이드 인사이트가 Kubernetes 버전 1.25로 업그레이드할 때 지원 중단으로 인해 API를 활용하는 클러스터에서 실행 중인 리소스 유형을 식별하는 데 도움이 된다는 것을 알 수 있습니다.

리소스 유형은 동일하지만 API 버전을 업데이트해야 하는 경우 kubectl-convert 명령을 사용하여 매니페스트 파일을 자동으로 변환할 수 있습니다.

kubectl-convert: 매니페스트 마이그레이션을 위한 도구

kubectl-convert는 Kubernetes 매니페스트를 최신 API 버전에서 작동하도록 마이그레이션하는 데 편리한 유틸리티입니다. 이는 API가 최신 Kubernetes 릴리스에서 더 이상 사용되지 않거나 제거될 때 중요해집니다. 도움이 될 수 있습니다.

- API 버전 업데이트: 매니페스트가 더 이상 사용되지 않는 API(예: Ingress의 extensions/v1beta1)를 사용하는 경우 kubectl-convert가 이를 지원되는 버전(예: networking.k8s.io/v1)으로 업데이트할 수 있습니다.

- 호환성 보장: 매니페스트의 API 버전을 업데이트하면 kubectl-convert가 Kubernetes 클러스터 업그레이드 후에도 애플리케이션이 원활하게 작동하도록 보장합니다.

kubectl-convert는 플러그인입니다. 이전 버전의 kubectl에는 kubectl-convert가 내장되어 있었지만, 이제는 별도의 플러그인입니다. 사용하기 전에 설치해야 합니다( https://kubernetes.io/docs/tasks/tools/install-kubectl-linux/#install-kubectl-convert-plugin ) ).

kubectl-convert 사용:

기본 사용법에는 매니페스트 파일과 원하는 출력 버전을 지정하는 것이 포함됩니다.

Memo :

kubectl convert -f <manifest_file> --output-version <api_group>/<version>

ex)

kubectl convert -f deployment.yaml --output-version apps/v1

이 명령은 apps/v1 API 버전을 사용하도록 deployment.yaml 파일을 업데이트합니다(이전 버전을 사용하고 있다고 가정).

Memorize !!

- kubectl-convert로 매니페스트를 업데이트한 후 kubectl apply를 사용하여 클러스터에 다시 적용해야 합니다.

- kubectl-convert를 사용하기 전에 원본 매니페스트를 백업하는 것이 좋습니다. kubectl-convert를 활용하여 매니페스트를 마이그레이션하면 새로운 Kubernetes 버전으로 원활하게 전환하고 애플리케이션 중단을 피할 수 있습니다.

▶ AWS EKS 업그레이드 체크리스트

EKS 문서를 사용하여 업그레이드 체크리스트를 만듭니다. EKS Kubernetes 버전 설명서에는 각 버전에 대한 자세한 변경 사항 목록이 포함되어 있습니다. 각 업그레이드에 대한 체크리스트를 작성하세요.

EKS 버전 업그레이드에 대한 구체적인 지침은 설명서를 참조하여 각 버전의 주요 변경 사항과 고려 사항을 확인하세요.

API를 사용하여 Kubernetes 애드온 및 구성 요소 업그레이드

Kubernetes 클러스터를 업그레이드하려면 다양한 구성 요소를 신중하게 고려해야 합니다.

- API 종속 구성 요소 식별: 업그레이드하기 전에 다음을 사용하여 모든 클러스터 구성 요소를 나열합니다.

kubectl get ns | grep -e '-system'

이를 통해 Kubernetes API와 직접 상호 작용하는 모니터링 에이전트, 자동 확장기 및 스토리지 드라이버와 같은 중요한 구성 요소를 정확히 찾는 데 도움이 됩니다.

- 호환성을 위해 설명서를 확인하세요:

식별된 각 구성 요소에 대해 해당 설명서를 참조하여 대상 Kubernetes 버전과의 호환성을 확인하세요. AWS Load Balancer Controller 설명서와 같은 리소스는 버전 호환성 세부 정보를 제공합니다. 일부 구성 요소는 진행하기 전에 업그레이드 또는 구성 변경이 필요할 수 있습니다. CoreDNS, kube-proxy, Container Network Interface(CNI) 플러그인 및 스토리지 드라이버와 같은 중요한 구성 요소에 세심한 주의를 기울이세요.

- 애드온 및 타사 도구 업그레이드:

많은 클러스터는 Kubernetes API를 활용하여 유입 제어, 지속적인 전달 및 모니터링과 같은 기능을 제공하는 애드온 및 타사 도구에 의존합니다. EKS 클러스터를 업그레이드하려면 호환성을 유지하기 위해 이러한 도구를 업그레이드해야 합니다.

일반적인 추가 기능과 업그레이드 리소스를 살펴보겠습니다.

- Amazon VPC CNI : Amazon EKS 추가 기능 배포에 대한 업그레이드는 한 번에 하나의 마이너 버전 업그레이드로 제한됩니다.